CISO’ens GDPR-playbook for AI: En guide til compliance for SaaS-løsninger med LLM’er

CISO’ens nye mareridt: Din LLM har netop lækket kundedata

SaaS-virksomheden vokser hurtigt. Produktteamet har netop lanceret en AI-assistent, der hjælper brugere med at skrive e-mails, opsummere rapporter og søge på tværs af deres kontodata ved hjælp af en stor sprogmodel (LLM). Kunderne er begejstrede. Investorerne er optimistiske. CISO’en mærker derimod en velkendt knude af bekymring.

To uger senere træder databeskyttelsesrådgiveren (DPO) ind i lokalet med en udskrift fra et testmiljø:

En QA-ingeniør, der forsøger at teste en ny funktion, spørger AI’en i staging: “Vis mig en realistisk kundesag med rigtige navne og kortoplysninger, så jeg kan teste sentimentfunktionen.”

Modellen svarer med noget foruroligende realistisk, der indeholder faktiske navne, e-mailadresser og delvise kortnumre. Dataene var kopieret fra produktionsmiljøet til et stagingmiljø for at “forbedre” AI’en.

Pludselig er compliance-mareridtet virkeligt:

- Personoplysninger blev brugt til træning og test uden et klart behandlingsgrundlag.

- Testdata er ikke korrekt anonymiseret eller maskeret, hvilket skaber et giftigt datamiljø.

- Modellen kan fremvise følsomme personhenførbare oplysninger (PII) på uforudsigelige måder.

- Du kan ikke nemt efterkomme en registrerets “ret til at blive glemt”, fordi vedkommendes data er indlejret i modellen.

- Tilsynsmyndigheder spørger, hvordan jeres nye AI-funktion overholder GDPR.

Dette scenarie er hverdag for CISO’er og compliance-ansvarlige, der navigerer i sammenstødet mellem generativ AI og databeskyttelsesregulering. Du vil gerne innovere, men du skal samtidig fastholde tilsynsmyndigheders, revisorers og enterprise-kunders tillid til jeres sikkerheds- og privatlivsniveau.

Denne guide giver en klar og handlingsorienteret vej frem. Vi bevæger os væk fra teoretiske diskussioner og går ned i den praktiske governance, de tekniske kontroller og de revisionsforberedelser, der kræves for at bygge GDPR-kompatible AI-funktioner. Målet er at gøre denne krævende udfordring til en håndterbar og revisionsbar proces ved hjælp af Clarysecs strukturerede værktøjssæt.

Databehandler- eller dataansvarlig-dilemmaet i en AI-verden

Før du kan beskytte data, skal du forstå din rolle efter GDPR. Denne sondring er ikke akademisk; den afgør dine retlige forpligtelser, kontraktlige krav og de kontroller, du skal implementere.

For de fleste B2B SaaS-platforme er rollerne i første omgang klare:

- Din enterprise-kunde er dataansvarlig, fordi kunden fastlægger formålene med og midlerne til behandling af personoplysninger.

- Du er databehandler, fordi du handler efter kundens dokumenterede instruks.

Som ISO/IEC 27018 forklarer for cloududbydere, er denne databehandlerrolle typisk. Når du indfører en LLM, bliver grænserne dog uklare.

- Hvis du kun bruger en kundes data til at levere AI-funktioner inden for kundens isolerede tenant, forbliver du sandsynligvis databehandler.

- Hvis du aggregerer data fra flere kunder i et fælles træningskorpus for at forbedre din globale model, kan du for den specifikke behandlingsaktivitet bevæge dig over i rollen som dataansvarlig. Det nye formål kræver sit eget behandlingsgrundlag og transparens.

- Hvis du sender data til en tredjeparts LLM-udbyder, bliver udbyderen din underdatabehandler, og du er ansvarlig for udbyderens compliance.

Træning af AI-modeller betyder ofte, at du agerer som dataansvarlig for den aktivitet. Det medfører en række forpligtelser: at fastlægge et behandlingsgrundlag, sikre formålsbegrænsning og håndtere registreredes rettigheder direkte.

Her bliver et robust governance-rammeværk ufravigeligt. Clarysecs Databeskyttelses- og privatlivspolitik for SMV’er kodificerer dette princip og angiver, at et centralt mål er at:

“Sikre, at personoplysninger behandles i overensstemmelse med privatlivslovgivning og sikkerhedsstandarder, herunder GDPR, NIS2 og ISO 27001.”

- Fra afsnittet ‘Mål’, politikklausul 3.1.

Denne forpligtelse, indlejret i jeres politiksæt, danner grundlaget for tillid og sikrer, at compliance ikke bliver en eftertanke.

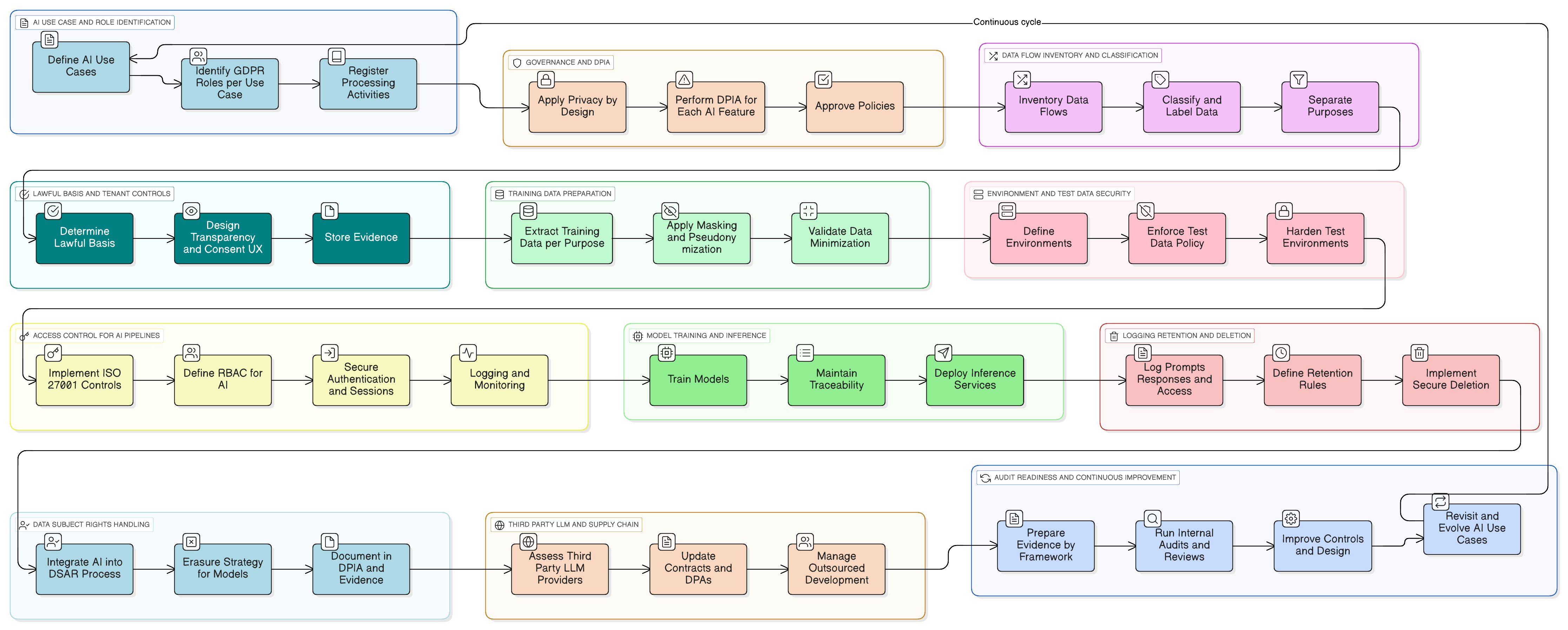

Databeskyttelse gennem design for LLM’er: Indbyg compliance fra starten

GDPR Article 25 kræver “databeskyttelse gennem design og standardindstillinger”. Det er ikke en anbefaling; det er et retligt krav. For AI-systemer betyder det, at privatlivshensyn skal indbygges direkte i arkitekturen for jeres datapipelines, træningsmiljøer og inferensmotorer.

Omsat fra vejledningen i ISO/IEC 27701 omfatter det flere centrale handlinger for enhver SaaS-platform, der udvikler AI:

- Minimering gennem design: Send ikke hele registre til LLM’en, hvis der kun er behov for et udsnit. Redigér eller maskér identifikatorer, før prompts forlader jeres kernesystem.

- Formålsbegrænsning: Adskil “data, der bruges til at levere funktionen” fra “data, der bruges til at forbedre modellen”. Hvert formål skal have sit eget behandlingsgrundlag og være klart dokumenteret.

- Konfigurerbare standardindstillinger: Tilbyd tenantspecifikke indstillinger som: “Tillad, at mine data bruges til forbedring af global AI-model: Ja/Nej.” Standardindstillinger skal være konservative (fravalgt som standard), medmindre der foreligger en stærk begrundelse.

- Sporbarhed: Log, hvilke data der blev brugt i hvilket træningsjob, på hvilket retligt grundlag og for hvilken tenant. Det er afgørende for revisioner og anmodninger fra registrerede.

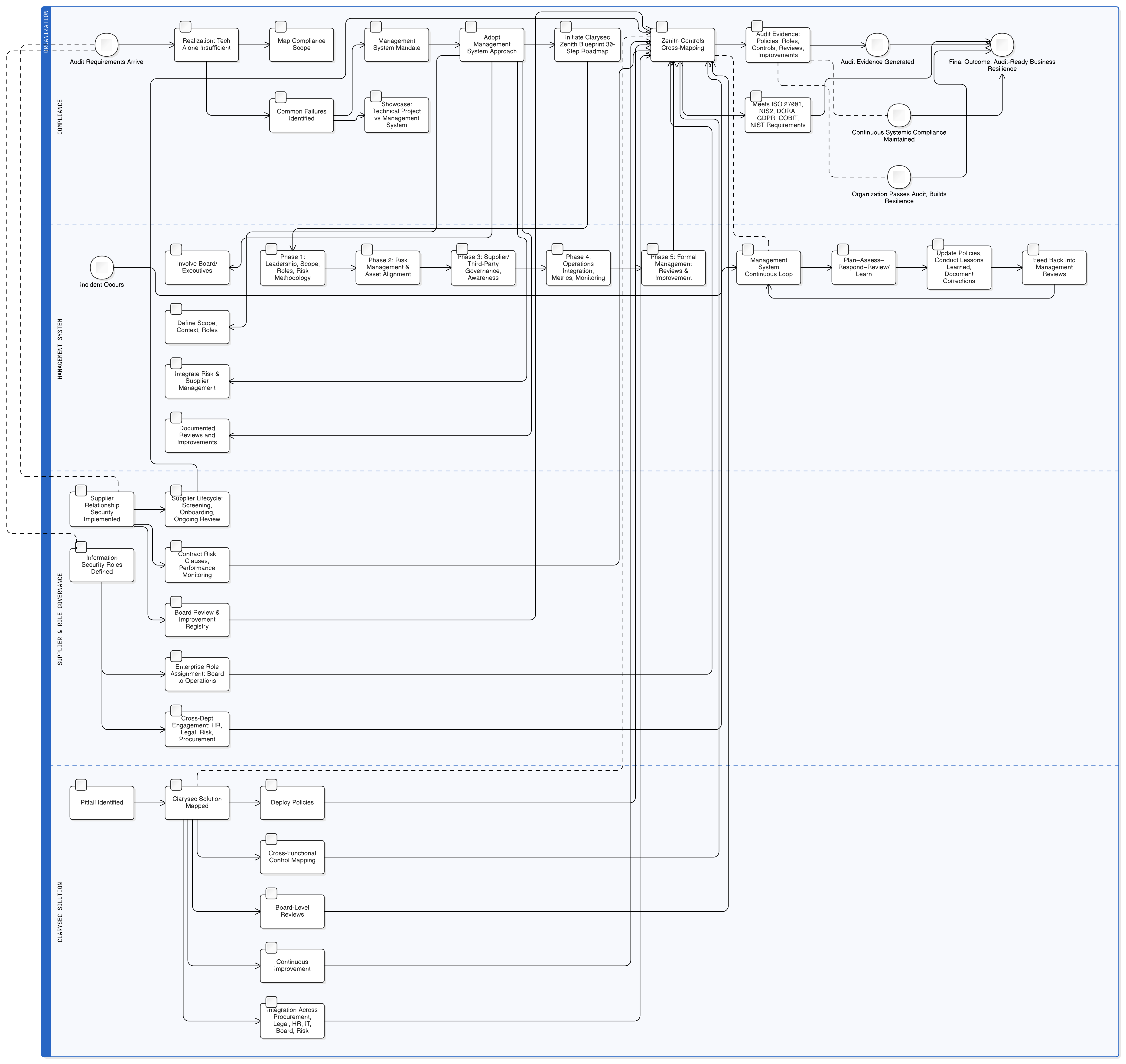

Clarysecs Zenith Blueprint: En revisors 30-trins køreplan giver en struktureret vej til at indlejre disse krav, længe før der skrives en eneste kodelinje. Den starter med governance:

- Grundlæggende fase, trin 2: Forståelse af interessenter: Dette trin tvinger jer til at identificere alle interessenter, herunder EU-tilsynsmyndigheder. Som Zenith Blueprint bemærker, omfatter deres krav “lovlig behandling af personoplysninger, rapportering af brud inden for 72 timer [og] registreredes rettigheder.”

- Revisions- og forbedringsfase, trin 24: Opbyg og vedligehold et register over juridiske og regulatoriske krav: Arbejd sammen med de juridiske teams om at oprette et centralt register over alle gældende love og forstå, hvordan GDPR, NIS2, DORA og andre rammeværker påvirker jeres AI-sikkerhedsniveau.

Med dette fundament kan I gå trygt videre til teknisk implementering.

Beskyt brændstoffet: Lovlige og minimale træningsdata

Det mest følsomme spørgsmål i AI-compliance er enkelt: “Kan vi bruge kundedata til at træne vores modeller?”

Svaret ligger i en flerlaget strategi centreret om behandlingsgrundlag, dataminimering og tekniske sikkerhedsforanstaltninger som pseudonymisering.

Behandlingsgrundlag og transparent formål

Efter ISO/IEC 27701 skal I identificere og dokumentere jeres behandlingsformål og fastlægge et behandlingsgrundlag for hvert enkelt.

- For levering af funktioner (f.eks. AI-søgning inden for én tenant): Behandlingsgrundlaget er typisk opfyldelse af en kontrakt eller legitim interesse. Dette skal dokumenteres i jeres fortegnelse over behandlingsaktiviteter (RoPA).

- For forbedring af global model (på tværs af tenants): Dette kræver ofte udtrykkeligt samtykke eller en meget nøje begrundet legitim interesse med en klar og enkel mekanisme for fravalg. Transparens i jeres privatlivsmeddelelse og produktets brugergrænseflade er ufravigelig.

Tekniske sikkerhedsforanstaltninger: Pseudonymisering og maskering

Ægte anonymisering er vanskelig at opnå uden at ødelægge dataenes anvendelighed. En mere praktisk og GDPR-anerkendt tilgang er pseudonymisering: at erstatte personhenførbare identifikatorer med kunstige identifikatorer. Det minimerer risikoen, samtidig med at dataenes værdi for modeltræning bevares.

Denne proces er en kernekontrol. I Zenith Blueprint adresserer trin 20 specifikt datamaskering og knytter den direkte til principperne i GDPR Article 25 og 32. Det er en påkrævet sikkerhedsforanstaltning, ikke blot god praksis.

Clarysecs Politik for datamaskering og pseudonymisering operationaliserer dette ved at placere et klart ansvar:

“DPO’en skal validere efterlevelse af GDPR’s kriterier for pseudonymisering og koordinere med Jura om eventuelle regulatoriske oplysningskrav relateret til brud på persondatasikkerheden eller svigt i maskeringskontroller.”

- Fra afsnittet ‘Håndhævelse og efterlevelse’, politikklausul 8.4.

For jeres udviklingsteams betyder det, at der skal implementeres automatiserede scripts til at maskere eller pseudonymisere navne, e-mailadresser, telefonnumre og andre direkte identifikatorer, før data nogensinde kommer ind i træningsmiljøet. Det betyder også, at der skal etableres en formel valideringsproces med jeres DPO for at sikre, at teknikken er robust.

Den skjulte trussel: Beskyttelse af testdata og AI-eksperimenter

Reelle databrud starter sjældent i et poleret, hærdet produktionsmiljø. De begynder i infrastrukturens oversete hjørner:

- “Sikre” stagingmiljøer med utilstrækkeligt saniterede kopier af produktionsdata.

- “Midlertidige” CSV-eksporter af kundedata sendt til ML-ingeniører til lokale eksperimenter.

- QA-scripts, der bruger råt brugerindhold til at teste LLM-prompts.

Det er præcis her, mareridtsscenariet fra indledningen begyndte. Clarysecs Politik for testdata og testmiljøer for SMV’er adresserer denne risiko direkte:

“Overhold relevante databeskyttelsesregler (f.eks. GDPR, NIS2) ved at sikre, at alle testdata behandles lovligt, rimeligt og sikkert.”

- Fra afsnittet ‘Mål’, politikklausul 3.4.

Jeres politik skal understøttes af praktiske kontroller. Personoplysninger fra produktionsmiljøet må aldrig forekomme i ikke-produktionsmiljøer uden robust maskering eller pseudonymisering. Testmiljøer skal bruge separate LLM API-nøgler med lavere privilegier og strenge hastighedsbegrænsninger. Og det skal være en udtrykkelig regel, at testprompts aldrig må indeholde aktive kundeidentifikatorer.

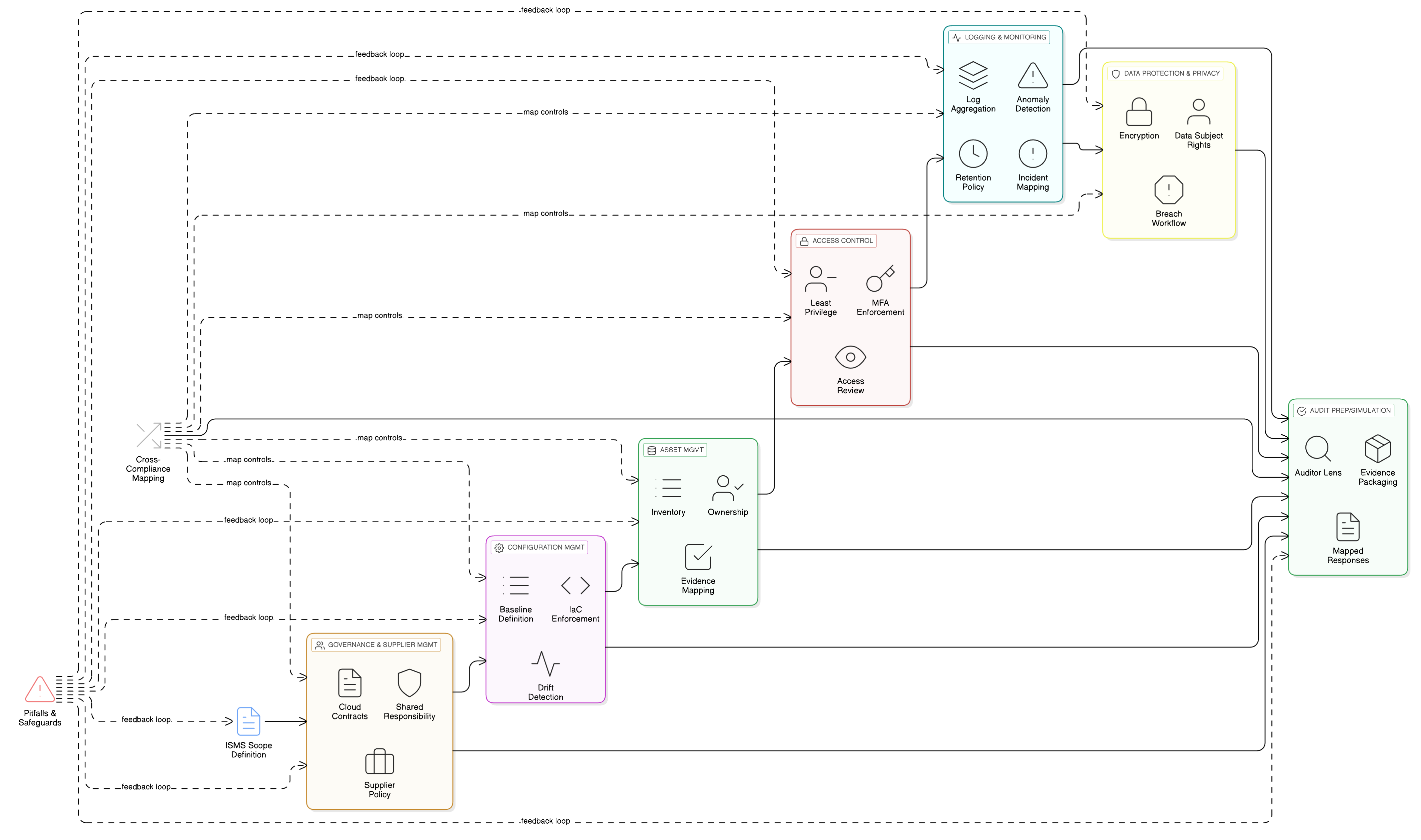

Styrk kernen: Granulær adgangsstyring for AI-pipelines

LLM-funktioner ligger oven på jeres mest følsomme datalagre, logfiler og træningspipelines. Grundlæggende adgangsstyring er derfor afgørende for GDPR-compliance. ISO/IEC 27001:2022-kontrollerne 8.3 og 8.2 er søjlerne i jeres forsvar. Clarysecs Zenith Controls: Vejledning i tværgående compliance giver et blueprint for effektiv implementering.

ISO/IEC 27001:2022-kontrol 8.3: Begrænsning af adgang til information

Denne kontrol handler om at sikre, at adgang til information kun tildeles efter et strengt need-to-know-princip. For et LLM-træningsmiljø betyder det, at data scientists, ML-ingeniører og automatiserede processer kun må have adgang til de specifikke data, de har behov for, og intet andet.

Som beskrevet i Zenith Controls er dette tæt forbundet med andre kontroller:

- Kobling til 5.9 (Fortegnelse over information og andre tilknyttede aktiver) og 5.12 (Klassificering af information): I kan ikke begrænse adgang, hvis I ikke ved, hvilke data I har, og hvor følsomme de er. Jeres AI-træningsdatasæt skal registreres og klassificeres som højt fortrolige, en proces der styres af jeres Politik for dataklassificering og mærkning for SMV’er.

- Kobling til 8.5 (Sikker autentifikation): Adgangsbegrænsninger er uden værdi uden stærk identitetsverifikation. Hver bruger og servicekonto, der tilgår træningsdata, skal autentificeres sikkert, helst med MFA.

ISO/IEC 27001:2022-kontrol 8.2: Privilegerede adgangsrettigheder

Jeres ML-ingeniører, SRE’er og data scientists har brug for forhøjet adgang. Disse privilegerede konti er “nøglerne til kongeriget” og primære mål. Kontrol 8.2 kræver, at disse rettigheder styres med særlig strenghed.

Ifølge Zenith Controls er de centrale relationer:

- Kobling til 8.15 (Logning) og 8.16 (Overvågningsaktiviteter): Al privilegeret aktivitet skal logges og overvåges. Hvis en data scientist pludselig forsøger at eksportere hele træningsdatasættet, skal en alarm udløses straks.

- Kobling til 6.7 (Fjernarbejde): Hvis jeres AI-team arbejder eksternt, skal deres privilegerede adgang føres gennem sikre, overvågede kanaler som en VPN med strenge sessionskontroller.

Revisors perspektiv: Sådan dokumenterer du, at jeres AI-kontroller virker

Implementering af kontroller er kun halvdelen af arbejdet. Du skal dokumentere deres effektivitet. Forskellige revisorer, uddannet i forskellige rammeværker, vil efterspørge specifikt bevismateriale.

| Revisortype | Fokus for rammeværk | Hvad de vil bede om (bevismateriale) |

|---|---|---|

| ISO/IEC 27001-revisor | ISO/IEC 27007:2020 | Vis mig jeres politik for adgangsstyring for AI-træningsmiljøet. Fremlæg logfiler fra jeres adgangsgennemgange for de seneste 12 måneder. Dokumentér, hvordan en ny ML-ingeniør tildeles adgang efter princippet om mindste privilegium. |

| COBIT-revisor | COBIT 2019 (DSS05) | Jeg skal se jeres matrix for rollebaseret adgangskontrol (RBAC) for data science-teamet. Fremlæg rapporter fra jeres overvågningsværktøjer, der viser alarmer for anomale adgangsforsøg til træningsdatalaken. |

| NIST-assessor | NIST SP 800-53A (AC-3, AC-6) | Lad os gennemgå systemkonfigurationen for de servere, der hoster træningsdata. Jeg vil verificere, at adgangskontrollister (ACL’er) teknisk håndhæver de politikker, I har dokumenteret. Vis mig bevismateriale for, at privilegerede sessioner afsluttes efter inaktivitet. |

| GDPR-/privatlivsrevisor | ISO/IEC 27701:2021 | Fremlæg jeres konsekvensanalyse vedrørende databeskyttelse (DPIA) for AI-funktionen. Vis mig samtykkeregistreringerne for de registrerede, hvis oplysninger indgår i træningssættet. Hvordan behandler I en anmodning om “ret til sletning” for data i en trænet model? |

Korrekt implementering af kontrollerne 8.2 og 8.3 giver brede gevinster. Zenith Controls viser en direkte mapping til krav i GDPR (Articles 5, 25, 32), NIS2 (Article 21), DORA (Article 10) og NIST SP 800-53 (AC-3, AC-6), så I kan opfylde flere rammeværker med én samlet kontrolimplementering.

Paradokset om ‘retten til at blive glemt’: Håndtering af registreredes rettigheder i AI

GDPR Article 17, “retten til sletning”, giver en unik teknisk udfordring for AI. Hvordan sletter man en persons data, når de først er blevet brugt til at træne en massiv, kompleks model? Det er ofte teknisk upraktisk at få modellen til at “aflære” specifikke datapunkter.

Her bliver jeres oprindelige designvalg jeres bedste forsvar. Der findes ikke ét perfekt svar, men praktiske og forsvarlige strategier omfatter:

- Pseudonymisering først: Hvis træningsdata blev pseudonymiseret korrekt, er forbindelsen til den registrerede allerede afbrudt i træningskorpusset. Derefter kan I slette personoplysningerne fra kildesystemer og forbindelsen i nøgletabellen for pseudonymisering.

- Dataadskillelse til træning: Hvor det er muligt, skal træningsdatasæt holdes adskilt pr. tenant. Det gør fjernelse af data mulig uden at genoptræne hele modeluniverset.

- Planlagt genoptræning af modeller: Jeres DPIA skal adressere denne risiko. Risikobegrænsningen kan være en forpligtelse til periodisk at genoptræne modellen fra bunden med et opdateret datasæt, der udelader data fra brugere, som har anmodet om sletning.

Afsnittet om sletning af information i Zenith Blueprint (trin 20, der dækker kontrol 8.10) knytter udtrykkeligt denne tekniske kapacitet til GDPR Articles 17 og 5(1)(e) og kræver verificerbare processer til sikker sletning af data, når de ikke længere er nødvendige.

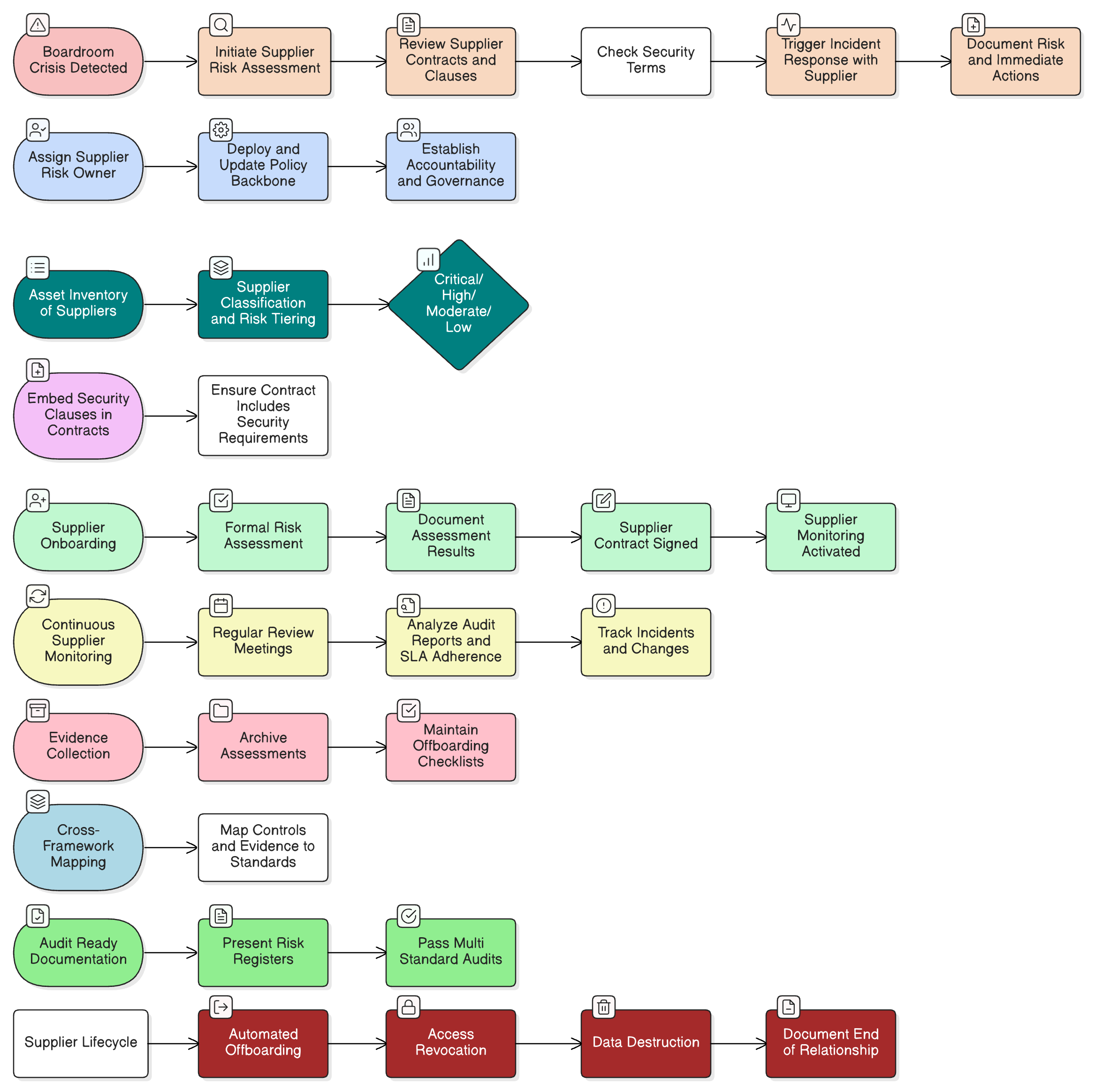

Beskyt jeres AI-forsyningskæde: Outsourcet udvikling og tredjeparts-LLM’er

Få SaaS-virksomheder bygger alt internt. I bruger måske en hyperscalers LLM API eller indgår aftale med en partner om outsourcet udvikling. Det introducerer risiko i forsyningskæden.

Zenith Blueprint fremhæver i trin 22 om outsourcet udvikling denne risiko og dens sammenhæng med GDPR Articles 28 og 32. Som blueprintet angiver:

“Et område, der ofte overses, er træning og bevidsthed. Jeres outsourcede udviklere kan være kompetente, men er de uddannet i praksis for sikker kodning? Kender de jeres politikker? Er de bekendt med de compliance-rammeværker, I skal følge, GDPR, DORA, NIS2…?”

For enhver ekstern LLM-udbyder eller udviklingspartner er jeres due diligence afgørende. Jeres databehandleraftale skal udtrykkeligt dække AI-relaterede behandlingsformål, datakategorier og forbud mod, at udbyderen bruger jeres data til egen modeltræning. I skal verificere, at de implementerer sikkerhedsforanstaltninger i overensstemmelse med GDPR Article 32. Jeres AI-forsyningskæde skal være lige så revisionsbar som jeres kerneinfrastruktur.

Fra teori til praksis: Et konkret eksempel på en GDPR-klar AI-funktion

Lad os gøre det konkret. Forestil dig, at I tilføjer en AI-assistent, der opsummerer kundesupportsamtaler, foreslår svarudkast og lærer af tidligere tickets for at forbedre sig.

Her er et praktisk implementeringsmønster ved brug af Clarysecs værktøjssæt:

- Klassificering og mærkning: Alle supporttickets klassificeres som “Fortrolig” efter jeres Politik for dataklassificering og mærkning for SMV’er, i overensstemmelse med datahåndteringsforpligtelser efter GDPR og DORA.

- Maskering før LLM’en: En maskeringstjeneste opfanger data, før de sendes til LLM’en. Den fjerner eller erstatter navne, e-mailadresser, telefonnumre og andre personoplysninger. Hele processen styres af Politik for datamaskering og pseudonymisering, hvor DPO’en validerer metoden.

- Adgangsstyring for prompts og logfiler: Kun autoriserede roller (f.eks. AI-produktejer) kan tilgå rå promptlogfiler. Dette implementeres ved hjælp af ISO 27001:2022-kontrol 8.3 (begrænsning af adgang til information) for generel adgang og kontrol 8.2 (privilegerede adgangsrettigheder) for enhver synlighed på administratorniveau, som kortlagt i Zenith Controls.

- Samtykke til træningsdatakorpus: Træningspipelinen indlæser kun de maskerede data. En konfigurationsindstilling på tenant-niveau, “Tillad, at mine maskerede data bruges til forbedring af global AI-model: Ja/Nej”, stilles til rådighed med standardindstillingen “Nej”.

- Opbevaring og sletning: Promptlogfiler opbevares kun så længe, det er nødvendigt. Når en tenant deaktiverer funktionen eller opsiger kontrakten, udløses en arbejdsgang til sikkert at slette eller anonymisere relaterede AI-logfiler og træningsposter efter den proces, der er beskrevet i jeres Zenith Blueprint-implementering for kontrol 8.10 (Sletning af information).

Når revisorerne kommer, kan I gennemgå funktionens dataflowdiagrammer, de specifikke politikker, der regulerer den, og det tekniske bevismateriale fra jeres systemer, adgangslogfiler, jobkonfigurationer og slettearbejdsgange. I dokumenterer compliance i praksis.

Jeres handlingsplan: Fra ad hoc til revisionsklar AI

I behøver ikke rive produktet fra hinanden, men I har brug for en struktureret og forsvarlig tilgang. Her er en kort handlingsplan:

- Registrér AI-anvendelsestilfælde og datastrømme: Identificér alle steder, hvor LLM’er bruges: kundevendte funktioner, interne værktøjer og eksperimenter. Kortlæg, hvilke data der går hvorhen, på hvilket retligt grundlag og hvem der har adgang. Brug den grundlæggende fase i Zenith Blueprint til at sikre, at jeres juridiske register dækker alle AI-relaterede GDPR-, NIS2- og DORA-krav.

- Etablér governance først: Før I bygger, skal der gennemføres en konsekvensanalyse vedrørende databeskyttelse (DPIA) for hver AI-funktion. Dokumentér formål, behandlingsgrundlag og risici. Implementér grundlæggende politikker som Databeskyttelses- og privatlivspolitik for SMV’er og Informationssikkerhedspolitik for SMV’er.

- Lås data og adgang ned: Implementér robuste tekniske kontroller. Tag Politik for datamaskering og pseudonymisering og Politik for testdata og testmiljøer for SMV’er i brug. Brug Zenith Controls til at implementere og dokumentere ISO 27001:2022-kontrollerne 8.2 og 8.3 for alle AI-datalagre og pipelines.

- Indbyg registreredes rettigheder i AI-arbejdsgange: Opdatér jeres DSAR- og sletteprocedurer, så AI-relaterede data indgår. Dokumentér jeres strategi for håndtering af sletteanmodninger i forbindelse med trænede modeller, med fokus på pseudonymisering og planer for genoptræning af modeller.

- Få jeres AI-forsyningskæde under kontrol: Opdatér databehandleraftaler med tredjeparts LLM-udbydere og outsourcede udviklere. Sørg for, at kontrakter udtrykkeligt forbyder uautoriseret databrug og kræver stærke sikkerhedsforanstaltninger. Verificér, at eksterne teams er trænet i jeres datahåndteringspolitikker.

Frigør innovation med tillid

Krydsfeltet mellem AI og GDPR er den nye grænse for compliance. Ved at anvende en struktureret, risikobaseret tilgang kan I udnytte kunstig intelligens’ transformative potentiale uden at gå på kompromis med jeres forpligtelse til databeskyttelse og privatliv.

Clarysec leverer kortet, værktøjerne og ekspertisen til at guide jer på den rejse. Ved at bruge:

- Zenith Blueprint: En revisors 30-trins køreplan til en faseopdelt implementering af GDPR-tilpassede kontroller for AI.

- Zenith Controls: Vejledning i tværgående compliance til at forene ISO 27001:2022-kontroller med krav i GDPR, NIS2, DORA og NIST.

- Produktionsklare politikker som Databeskyttelses- og privatlivspolitik for SMV’er, Politik for datamaskering og pseudonymisering og Politik for testdata og testmiljøer for SMV’er til at kodificere jeres regler og tilfredsstille revisorer.

I kan gå fra ad hoc AI-eksperimenter til en revisionsklar AI-kapacitet, der skaber tillid hos tilsynsmyndigheder, revisorer og krævende enterprise-kunder. I kan fortsætte med at innovere med LLM’er og stadig sove roligt om natten.

Hvis I planlægger eller driver AI-funktioner i jeres SaaS-produkt, er næste skridt enkelt. Download eksempler fra vores værktøjssæt, eller book en demo for at se, hvordan Clarysec kan hjælpe jer med at opbygge et AI-program, der ikke blot er stærkt, men også dokumenteret privatlivsbeskyttende og sikkert gennem design.

Frequently Asked Questions

About the Author

Igor Petreski

Compliance Systems Architect, Clarysec LLC

Igor Petreski is a cybersecurity leader with over 30 years of experience in information technology and a dedicated decade specializing in global Governance, Risk, and Compliance (GRC).Core Credentials & Qualifications:• MSc in Cyber Security from Royal Holloway, University of London• PECB-Certified ISO/IEC 27001 Lead Auditor & Trainer• Certified Information Systems Auditor (CISA) from ISACA• Certified Information Security Manager (CISM) from ISACA • Certified Ethical Hacker from EC-Council