Informācijas drošības vadītāja GDPR rokasgrāmata mākslīgā intelekta jomā: ceļvedis SaaS LLM atbilstībai

Informācijas drošības vadītāja jaunais murgs: jūsu LLM tikko nopludināja klientu datus

SaaS uzņēmums strauji aug. Produkta komanda tikko ir laidusi klajā AI asistentu, kas palīdz lietotājiem sagatavot e-pastus, apkopot pārskatus un meklēt savos konta datos, izmantojot lielo valodas modeli (LLM). Klienti ir sajūsmā. Investori ir optimistiski. Taču informācijas drošības vadītājs izjūt pazīstamu spriedzi.

Pēc divām nedēļām datu aizsardzības speciālists (DPO) ienāk telpā ar izdruku no testa vides:

QA inženieris, mēģinot testēt jaunu funkciju, sagatavošanas vidē pajautāja AI: “Parādi man reālistisku klienta pieteikumu ar īstiem vārdiem un karšu datiem, lai varu testēt noskaņojuma noteikšanas funkciju.”

Modelis atbildēja ar satraucoši reālistisku piemēru, kurā bija īsti vārdi, e-pasta adreses un daļēji karšu numuri. Dati bija nokopēti no ražošanas vides uz sagatavošanas vidi, lai “uzlabotu” AI.

Pēkšņi atbilstības murgs kļūst reāls:

- Personas dati tika izmantoti apmācībai un testēšanai bez skaidra tiesiskā pamata.

- Testa dati nav pienācīgi anonimizēti vai maskēti, radot toksisku datu vidi.

- Modelis neparedzamos veidos var atklāt sensitīvus personas datus vai personu identificējošu informāciju (PII).

- Nav viegli izpildīt datu subjekta “tiesības tikt aizmirstam”, jo viņa dati ir iestrādāti modelī.

- Regulatori jautā, kā jūsu jaunā, spožā AI funkcija atbilst GDPR.

Šāds scenārijs ir ikdienas realitāte informācijas drošības vadītājiem un atbilstības vadītājiem, kuri strādā generatīvā AI un datu aizsardzības regulējuma sadursmes punktā. Jūs vēlaties ieviest inovācijas, bet vienlaikus jāuztur regulatoru, auditoru un uzņēmuma klientu pārliecība par jūsu drošības un privātuma stāvokli.

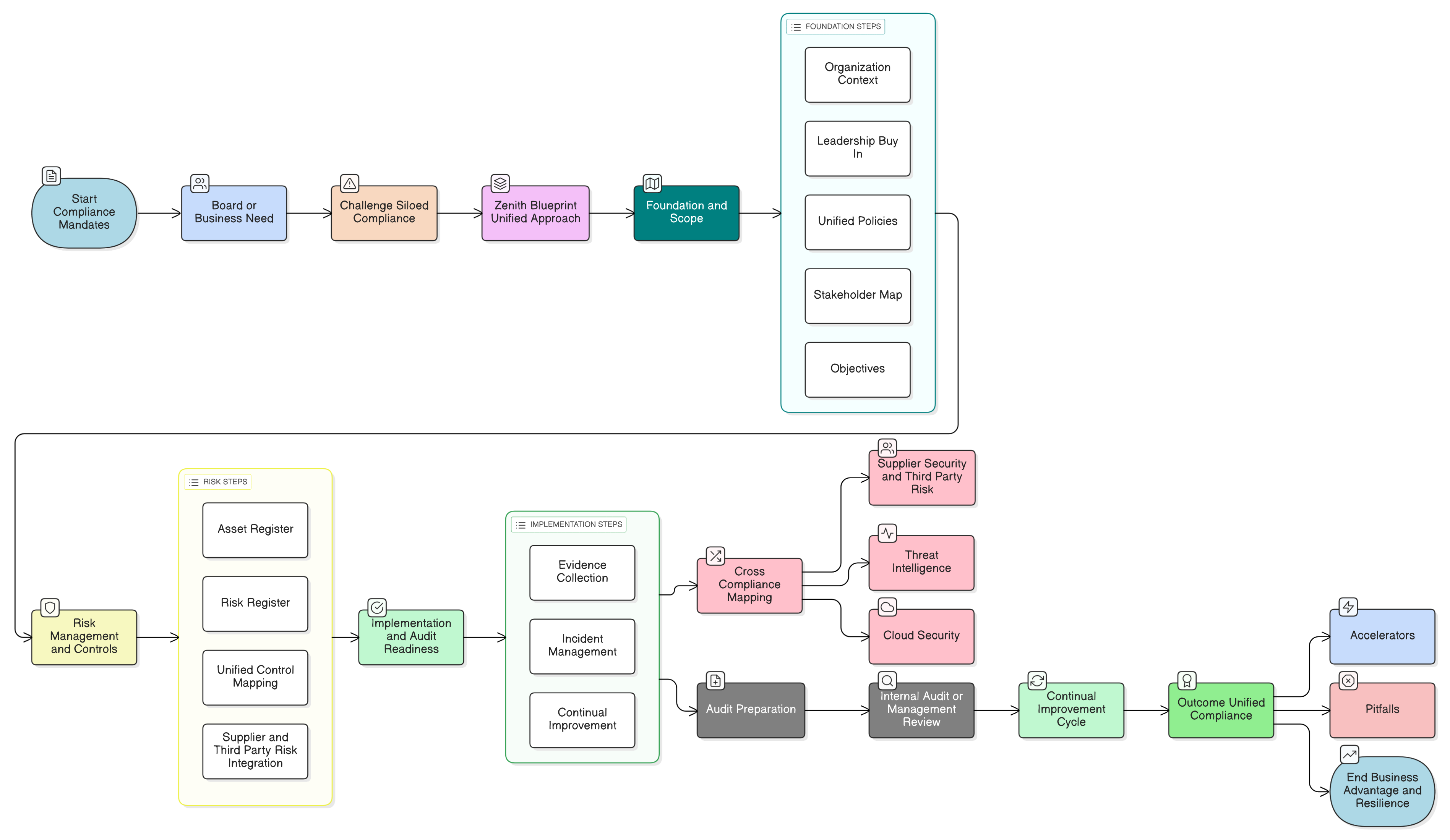

Šis ceļvedis sniedz skaidru un praktiski īstenojamu rīcības virzienu. Mēs pāriesim no teorētiskām diskusijām uz praktisku pārvaldību, tehniskajiem kontroles pasākumiem un audita sagatavošanu, kas nepieciešama GDPR atbilstošu AI funkciju izveidei, pārvēršot šo sarežģīto izaicinājumu pārvaldāmā un auditējamā procesā ar Clarysec strukturētajām rīkkopām.

Apstrādātāja un pārziņa dilemma AI pasaulē

Pirms varat aizsargāt datus, jums jāsaprot sava loma saskaņā ar GDPR. Šī atšķirība nav akadēmiska; tā nosaka jūsu juridiskos pienākumus, līgumiskās prasības un kontroles pasākumus, kas jāievieš.

Lielākajai daļai B2B SaaS platformu lomas sākotnēji ir skaidras:

- Jūsu uzņēmuma klients ir personas datu pārzinis, jo tas nosaka personas datu apstrādes nolūkus un līdzekļus.

- Jūs esat personas datu apstrādātājs, kas rīkojas pēc klienta dokumentētām instrukcijām.

Kā ISO/IEC 27018 skaidro mākoņpakalpojumu sniedzējiem, šāda apstrādātāja loma ir tipiska. Tomēr, ieviešot LLM, robežas kļūst neskaidras.

- Ja klienta datus izmantojat tikai AI funkciju nodrošināšanai viņa izolētajā nomnieka vidē, jūs, visticamāk, paliekat apstrādātājs.

- Ja apkopojat vairāku klientu datus kopīgā apmācības korpusā, lai uzlabotu savu globālo modeli, šai konkrētajai apstrādes darbībai jūs varat pāriet pārziņa lomā. Šim jaunajam nolūkam nepieciešams savs tiesiskais pamats un pārredzamība.

- Ja nosūtāt datus trešās puses LLM pakalpojumu sniedzējam, šis sniedzējs kļūst par jūsu apakšapstrādātāju, un jūs esat atbildīgs par tā atbilstību.

Iesaistīšanās AI modeļa apmācībā bieži nozīmē, ka šai darbībai jūs rīkojaties kā datu pārzinis, un tas rada virkni pienākumu: noteikt tiesisko pamatu, nodrošināt nolūka ierobežošanu un tieši pārvaldīt datu subjektu tiesības.

Tieši šeit spēcīgs pārvaldības ietvars kļūst obligāts. Clarysec Datu aizsardzības un privātuma politika MVU nostiprina šo principu, nosakot, ka viens no pamatmērķiem ir:

“Nodrošināt, ka personas dati tiek apstrādāti saskaņā ar privātuma tiesību aktiem un drošības standartiem, tostarp GDPR, NIS2 un ISO 27001.”

- No sadaļas “Mērķi”, politikas punkts 3.1.

Šī apņemšanās, kas iestrādāta jūsu politiku kopumā, veido pamatu uzticībai un nodrošina, ka atbilstība netiek risināta kā pēcdoma.

Integrēta datu aizsardzība LLM vidē: atbilstība jāiebūvē, nevis jāpievieno

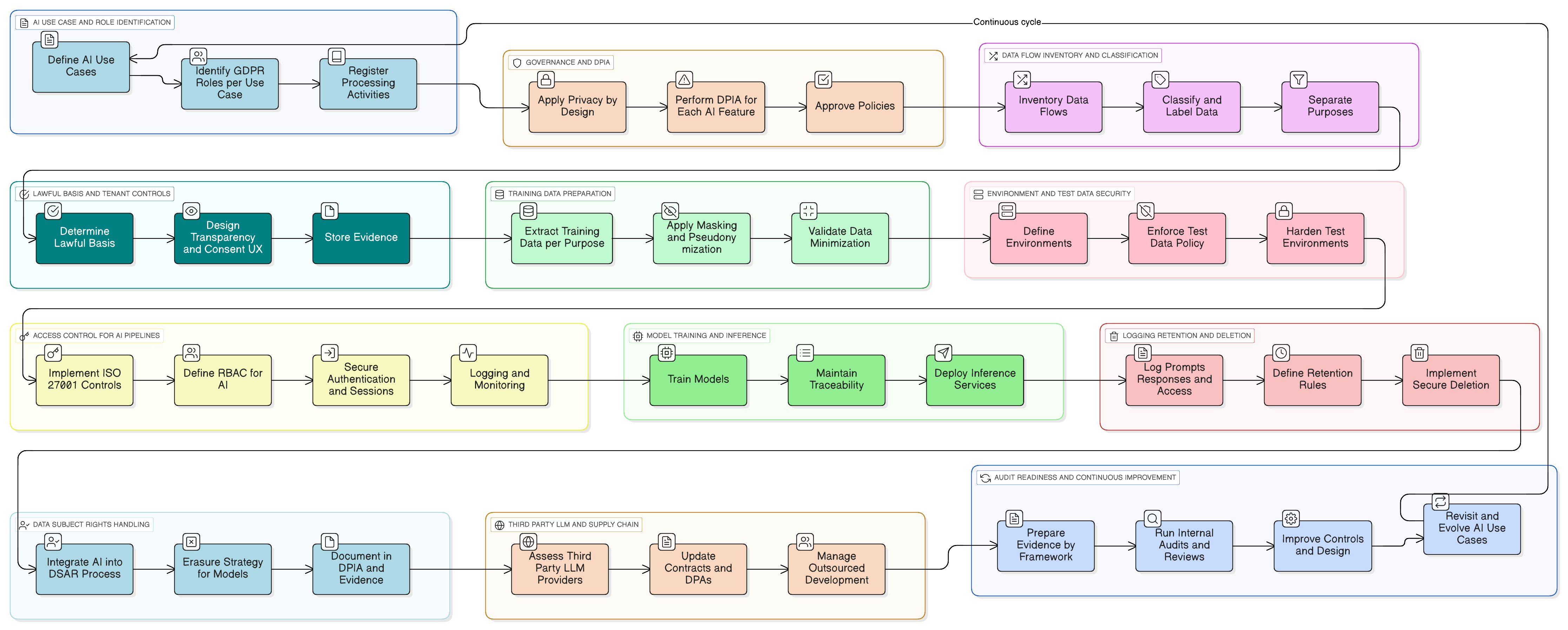

GDPR 25. pants pieprasa “integrētu datu aizsardzību un datu aizsardzību pēc noklusējuma”. Tas nav ieteikums; tā ir juridiska prasība. AI sistēmām tas nozīmē, ka privātuma apsvērumi jāiestrādā tieši datu cauruļvadu, apmācības vides un inferenču dzinēju arhitektūrā.

Pārfrāzējot ISO/IEC 27701 vadlīnijas, jebkurai SaaS platformai, kas izstrādā AI, tas ietver vairākas pamatdarbības:

- Minimizēšana pēc projektēšanas: Nesūtiet LLM pilnus ierakstus, ja nepieciešama tikai to daļa. Rediģējiet vai maskējiet identifikatorus, pirms uzvednes atstāj jūsu pamatsistēmu.

- Nolūka ierobežošana: Nošķiriet “datus, ko izmanto funkcijas nodrošināšanai”, no “datiem, ko izmanto modeļa uzlabošanai”. Katram nolūkam jābūt savam tiesiskajam pamatam un skaidri dokumentētam.

- Konfigurējami noklusējuma iestatījumi: Nodrošiniet nomnieka vides līmeņa slēdžus, piemēram: “Atļaut manu datu izmantošanu globālā AI modeļa uzlabošanai: Jā/Nē.” Noklusējuma iestatījumiem jābūt konservatīviem (pēc noklusējuma atteikts), ja vien nav spēcīga pamatojuma citai pieejai.

- Izsekojamība: Žurnālos reģistrējiet, kuri dati tika izmantoti kurā apmācības uzdevumā, ar kādu tiesisko pamatu un kurai nomnieka videi. Tas ir būtiski auditiem un datu subjektu pieprasījumiem.

Clarysec Zenith Blueprint: auditora 30 soļu ceļkarte sniedz strukturētu ceļu šo prasību iestrādei vēl ilgi pirms pirmās koda rindas uzrakstīšanas. Tas sākas ar pārvaldību:

- Pamata posms, 2. solis: ieinteresēto pušu izpratne: Šis solis liek identificēt visas iesaistītās puses, tostarp ES regulatorus. Kā norāda Zenith Blueprint, to prasības ietver “likumīgu personas datu apstrādi, ziņošanu par pārkāpumiem 72 stundu laikā [un] datu subjektu tiesības”.

- Audita un uzlabošanas posms, 24. solis: juridisko un regulatīvo prasību reģistra izveide un uzturēšana: Strādājiet ar juridiskajām komandām, lai izveidotu centrālo repozitoriju visiem piemērojamajiem tiesību aktiem un izprastu, kā GDPR, NIS2, DORA un citi regulējumi krustojas ar jūsu AI drošības stāvokli.

Ar šādu pamatu varat droši pāriet uz tehnisko ieviešanu.

Degvielas aizsardzība: likumīgi un minimāli apmācības dati

Sarežģītākais jautājums AI atbilstībā ir vienkāršs: “Vai drīkstam izmantot klientu datus savu modeļu apmācībai?”

Atbilde ir daudzslāņu stratēģijā, kuras centrā ir tiesiskais pamats, datu minimizēšana un tehniskie drošības pasākumi, piemēram, pseidonimizācija.

Tiesiskais pamats un pārredzams nolūks

Saskaņā ar ISO/IEC 27701 jums jāidentificē un jādokumentē apstrādes nolūki un katram no tiem jānosaka tiesiskais pamats.

- Funkcijas nodrošināšanai (piemēram, AI meklēšanai vienā nomnieka vidē): Tiesiskais pamats parasti ir līguma izpilde vai leģitīmās intereses. Tas jādokumentē jūsu apstrādes darbību reģistrā (RoPA).

- Globālā modeļa uzlabošanai (starp nomnieka vidēm): Tam bieži nepieciešama skaidra piekrišana vai ļoti rūpīgi pamatotas leģitīmās intereses ar skaidru un viegli izmantojamu atteikšanās mehānismu. Pārredzamība privātuma paziņojumā un produkta lietotāja saskarnē ir obligāta.

Tehniskie drošības pasākumi: pseidonimizācija un maskēšana

Patiesu anonimizāciju ir grūti panākt, neiznīcinot datu lietderību. Praktiskāka un GDPR atbalstīta pieeja ir pseidonimizācija: personas identifikatoru aizstāšana ar mākslīgiem identifikatoriem. Tas samazina risku, saglabājot datu vērtību modeļa apmācībai.

Šis process ir pamatkontrole. Zenith Blueprint 20. solī īpaši aplūko datu maskēšanu, tieši sasaistot to ar GDPR 25. un 32. panta principiem. Tas ir obligāts drošības pasākums, nevis tikai laba prakse.

Clarysec Datu maskēšanas un pseidonimizācijas politika to ievieš praksē, piešķirot skaidru atbildību:

“DPO ir jāvalidē atbilstība GDPR pseidonimizācijas kritērijiem un jāsaskaņo ar Juridisko dienestu jebkādas regulatīvās izpaušanas prasības, kas saistītas ar datu aizsardzības pārkāpumiem vai maskēšanas kontroles pasākumu kļūmēm.”

- No sadaļas “Ievērošana un atbilstība”, politikas punkts 8.4.

Jūsu izstrādes komandām tas nozīmē automatizētu skriptu ieviešanu vārdu, e-pasta adrešu, tālruņu numuru un citu tiešo identifikatoru maskēšanai vai pseidonimizēšanai, pirms dati jebkad nonāk apmācības vidē. Tas nozīmē arī formāla validācijas procesa izveidi kopā ar DPO, lai pārliecinātos, ka metode ir pietiekami noturīga.

Slēptais apdraudējums: testa datu un AI eksperimentu aizsardzība

Reāli datu aizsardzības pārkāpumi reti sākas glancētā, droši konfigurētā un nocietinātā ražošanas vidē. Tie sākas aizmirstajos infrastruktūras stūros:

- “Drošās” sagatavošanas vidēs ar nepietiekami attīrītām ražošanas datu kopijām.

- “Pagaidu” CSV eksportos ar klientu datiem, kas nosūtīti ML inženieriem lokāliem eksperimentiem.

- QA skriptos, kuros LLM uzvedņu testēšanai tiek izmantots neapstrādāts lietotāju saturs.

Tieši tur sākās ievadā aprakstītais murgainais scenārijs. Clarysec Testa datu un testa vides politika MVU tieši risina šo risku:

“Ievērot attiecīgos datu aizsardzības regulējumus (piemēram, GDPR, NIS2), nodrošinot, ka visi testa dati tiek apstrādāti likumīgi, godprātīgi un droši.”

- No sadaļas “Mērķi”, politikas punkts 3.4.

Politika jāatbalsta ar praktiskiem kontroles pasākumiem. Ražošanas vides PII nekad nedrīkst atrasties neražošanas vidēs bez spēcīgas maskēšanas vai pseidonimizācijas. Testa vidēm jāizmanto atsevišķas, zemāku privilēģiju LLM API atslēgas ar stingriem pieprasījumu intensitātes ierobežojumiem. Turklāt skaidri jānosaka, ka testa uzvednēs nekad nedrīkst iekļaut aktīvus klientu identifikatorus.

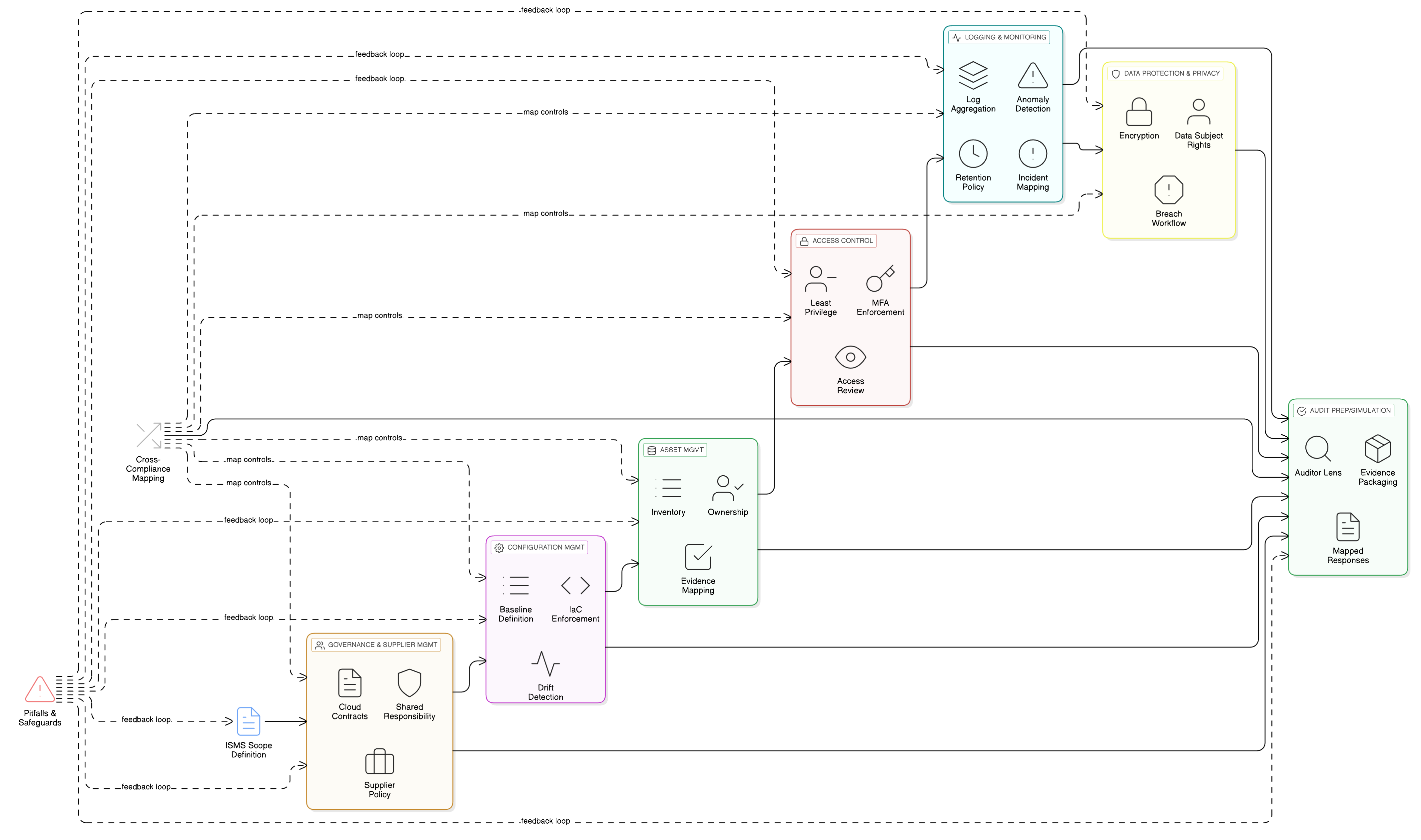

Kodola nocietināšana: granulāra piekļuves kontrole AI cauruļvadiem

LLM funkcijas balstās uz jūsu sensitīvākajām datu krātuvēm, žurnāliem un apmācības cauruļvadiem. Tāpēc pamata piekļuves kontrole ir izšķiroša GDPR atbilstībai. ISO/IEC 27001:2022 kontroles pasākumi 8.3 un 8.2 ir jūsu aizsardzības pīlāri. Clarysec Zenith Controls: savstarpējās atbilstības ceļvedis sniedz shēmu to efektīvai ieviešanai.

ISO/IEC 27001:2022 kontroles pasākums 8.3: informācijas piekļuves ierobežošana

Šis kontroles pasākums nodrošina, ka piekļuve informācijai tiek piešķirta stingri pēc principa “nepieciešams zināt”. LLM apmācības vidē tas nozīmē, ka jūsu datu zinātniekiem, ML inženieriem un pašiem automatizētajiem procesiem jābūt piekļuvei tikai tiem konkrētajiem datiem, kas tiem nepieciešami, un nekam vairāk.

Kā detalizēti aprakstīts Zenith Controls, tas ir cieši saistīts ar citiem kontroles pasākumiem:

- Saistība ar 5.9 (Inventory of information and other associated assets) un 5.12 (Classification of information): Piekļuvi nevar ierobežot, ja nezināt, kādi dati jums ir un cik sensitīvi tie ir. Jūsu AI apmācības datu kopa jāiekļauj uzskaitē un jāklasificē kā augsti konfidenciāla; šo procesu regulē jūsu Datu klasifikācijas un marķēšanas politika MVU.

- Saistība ar 8.5 (Secure authentication): Piekļuves ierobežojumi ir bezjēdzīgi bez spēcīgas identitātes pārbaudes. Katrs lietotājs un pakalpojuma konts, kas piekļūst apmācības datiem, ir droši jāautentificē, vēlams ar MFA.

ISO/IEC 27001:2022 kontroles pasākums 8.2: Privileged access rights

Jūsu ML inženieriem, SRE un datu zinātniekiem nepieciešama paaugstināta piekļuve. Šie priviliģētie konti ir “karaļvalsts atslēgas” un primāri mērķi. Kontroles pasākums 8.2 nosaka, ka šīs tiesības jāpārvalda ar īpašu stingrību.

Saskaņā ar Zenith Controls galvenās saistības ir:

- Saistība ar 8.15 (Logging) un 8.16 (Monitoring activities): Visas priviliģētās darbības jāreģistrē žurnālos un jāuzrauga. Ja datu zinātnieks pēkšņi mēģina eksportēt visu apmācības datu kopu, brīdinājumam jānostrādā nekavējoties.

- Saistība ar 6.7 (Remote working): Ja jūsu AI komanda strādā attālināti, tās priviliģētā piekļuve jānovirza caur drošiem, uzraudzītiem kanāliem, piemēram, VPN ar stingriem sesiju kontroles pasākumiem.

Auditora skatījums: kā pierādīt, ka jūsu AI kontroles pasākumi darbojas

Kontroles pasākumu ieviešana ir tikai puse no darba. Jums jāpierāda to efektivitāte. Dažādos ietvaros apmācīti auditori meklēs konkrētus pierādījumus.

| Auditora tips | Ietvara fokuss | Ko viņi pieprasīs (pierādījumi) |

|---|---|---|

| ISO/IEC 27001 auditors | ISO/IEC 27007:2020 | Parādiet piekļuves kontroles politiku AI apmācības videi. Iesniedziet žurnālus no piekļuves tiesību pārskatīšanas procesa par pēdējiem 12 mēnešiem. Demonstrējiet, kā jaunam ML inženierim tiek piešķirta piekļuve ar minimāli nepieciešamajām tiesībām. |

| COBIT auditors | COBIT 2019 (DSS05) | Man jāredz lomu balstītas piekļuves kontroles (RBAC) matrica datu zinātnes komandai. Iesniedziet pārskatus no uzraudzības rīkiem, kas rāda brīdinājumus par anomāliem piekļuves mēģinājumiem apmācības datu ezeram. |

| NIST izvērtētājs | NIST SP 800-53A (AC-3, AC-6) | Pārskatīsim apmācības datus mitinošo serveru sistēmas konfigurāciju. Vēlos pārbaudīt, ka piekļuves kontroles saraksti (ACL) tehniski piemēro dokumentētās politikas. Parādiet pierādījumus, ka priviliģētās sesijas tiek pārtrauktas pēc neaktivitātes. |

| GDPR/privātuma auditors | ISO/IEC 27701:2021 | Iesniedziet novērtējumu par ietekmi uz datu aizsardzību (DPIA) AI funkcijai. Parādiet piekrišanas ierakstus par datu subjektiem, kuru informācija ir apmācības kopā. Kā apstrādājat “tiesību uz dzēšanu” pieprasījumu attiecībā uz datiem apmācītā modelī? |

Pareiza kontroles pasākumu 8.2 un 8.3 ieviešana sniedz plašus ieguvumus. Zenith Controls parāda tiešu sasaisti ar prasībām GDPR (5., 25. un 32. pants), NIS2 (21. pants), DORA (10. pants) un NIST SP 800-53 (AC-3, AC-6), ļaujot ar vienotu kontroles ieviešanu izpildīt vairāku ietvaru prasības.

“Tiesību tikt aizmirstam” paradokss: datu subjektu tiesību pārvaldība AI vidē

GDPR 17. pants — “tiesības uz dzēšanu” — AI jomā rada unikālu tehnisku izaicinājumu. Kā dzēst personas datus, ja tie jau izmantoti masīva, sarežģīta modeļa apmācībai? Bieži konkrētu datu punktu “atmešana” tehniski nav īstenojama.

Tieši šeit sākotnējie projektēšanas lēmumi kļūst par jūsu labāko aizsardzību. Vienas ideālas atbildes nav, taču praktiskas un aizstāvamas stratēģijas ietver:

- Vispirms pseidonimizācija: Ja apmācības dati tika pienācīgi pseidonimizēti, saikne ar personu apmācības korpusā jau ir pārrauta. Pēc tam varat dzēst personas datus no avotsistēmām un saiti pseidonimizācijas atslēgu tabulā.

- Datu nošķiršana apmācībai: Kur iespējams, uzturiet atsevišķas apmācības datu kopas katrai nomnieka videi. Tas padara datu izņemšanu īstenojamu bez visa modeļu kopuma atkārtotas apmācības.

- Plānota modeļa atkārtota apmācība: Jūsu DPIA jāaplūko šis risks. Riska mazināšana var būt apņemšanās periodiski pārapmācīt modeli no nulles, izmantojot atjauninātu datu kopu, kurā izslēgti to lietotāju dati, kuri pieprasījuši dzēšanu.

Zenith Blueprint sadaļa par informācijas dzēšanu (20. solis, aptverot kontroles pasākumu 8.10) tieši sasaista šo tehnisko spēju ar GDPR 17. pantu un 5(1)(e) pantu, pieprasot verificējamus procesus drošai datu dzēšanai, kad tie vairs nav nepieciešami.

AI piegādes ķēdes aizsardzība: ārpakalpojuma izstrāde un trešo pušu LLM

Tikai dažas SaaS kompānijas visu būvē pašu spēkiem. Jūs varat izmantot hiperskalētāja LLM API vai piesaistīt ārpakalpojuma izstrādes partneri. Tas ievieš piegādes ķēdes risku.

Zenith Blueprint 22. solī par ārpakalpojuma izstrādi izceļ šo risku un tā saistību ar GDPR 28. un 32. pantu. Kā norādīts ceļvedī:

“Bieži nepietiekami novērtēta joma ir apmācība un informētība. Jūsu ārpakalpojuma izstrādātāji var būt kompetenti, bet vai viņi ir apmācīti drošas kodēšanas praksēs? Vai viņi pārzina jūsu politikas? Vai viņi apzinās atbilstības ietvarus, kas jums jāievēro — GDPR, DORA, NIS2…?”

Jebkuram ārējam LLM pakalpojumu sniedzējam vai izstrādes partnerim sākotnējā izpēte ir kritiski svarīga. Jūsu datu apstrādes pielikumam (DPA) skaidri jāaptver ar AI saistītie apstrādes nolūki, datu kategorijas un aizliegumi pakalpojumu sniedzējam izmantot jūsu datus sava modeļa apmācībai. Jums jāpārbauda, ka tas īsteno drošības pasākumus, kas saskaņoti ar GDPR 32. pantu. Jūsu AI piegādes ķēdei jābūt tikpat auditējamai kā jūsu pamata infrastruktūrai.

No teorijas līdz praksei: konkrēts GDPR gatavas AI funkcijas piemērs

Padarīsim to konkrētu. Iedomājieties, ka pievienojat AI asistentu, kas apkopo klientu atbalsta sarunas, iesaka atbilžu melnrakstus un mācās no iepriekšējiem pieteikumiem, lai uzlabotos.

Praktisks ieviešanas modelis, izmantojot Clarysec rīkkopu:

- Klasifikācija un marķēšana: Visi atbalsta pieteikumi tiek klasificēti kā “konfidenciāli” saskaņā ar jūsu Datu klasifikācijas un marķēšanas politiku MVU, nodrošinot atbilstību GDPR un DORA datu apstrādes pienākumiem.

- Maskēšana pirms LLM: Maskēšanas pakalpojums pārtver datus pirms to nosūtīšanas LLM. Tas noņem vai aizstāj vārdus, e-pasta adreses, tālruņu numurus un citu PII. Visu šo procesu regulē Datu maskēšanas un pseidonimizācijas politika, un DPO validē metodoloģiju.

- Piekļuves kontroles pasākumi uzvednēm un žurnāliem: Neapstrādātiem uzvedņu žurnāliem var piekļūt tikai autorizētas lomas (piemēram, AI produkta īpašnieks). Tas tiek īstenots, izmantojot ISO 27001:2022 kontroles pasākumu 8.3 (informācijas piekļuves ierobežošana) vispārējai piekļuvei un kontroles pasākumu 8.2 (priviliģētās piekļuves tiesības) jebkādai administratora līmeņa redzamībai, kā kartēts Zenith Controls.

- Piekrišana apmācības datu korpusam: Apmācības cauruļvads uzņem tikai maskētus datus. Tiek nodrošināts nomnieka vides līmeņa konfigurācijas iestatījums “Atļaut manu maskēto datu izmantošanu globālā AI modeļa uzlabošanai: Jā/Nē”, kura noklusējuma vērtība ir “Nē”.

- Glabāšana un dzēšana: Uzvedņu žurnāli tiek glabāti tikai tik ilgi, cik nepieciešams. Kad nomnieka vide atspējo funkciju vai izbeidz līgumu, tiek ierosināta darbplūsma, lai droši dzēstu vai anonimizētu saistītos AI žurnālus un apmācības ierakstus, ievērojot procesu, kas aprakstīts jūsu Zenith Blueprint ieviešanā kontroles pasākumam 8.10 (Information deletion).

Kad ierodas auditori, varat viņiem izskaidrot funkcijas datu plūsmas shēmas, konkrētās politikas, kas to regulē, un tehniskos pierādījumus no sistēmām, piekļuves žurnāliem, uzdevumu konfigurācijām un dzēšanas darbplūsmām. Jūs pierādāt atbilstību darbībā.

Jūsu rīcības plāns: no ad hoc pieejas līdz auditgatavam AI

Jums nav jāpārbūvē viss produkts, taču ir nepieciešama strukturēta un aizstāvama pieeja. Īss rīcības plāns:

- AI izmantošanas gadījumu un datu plūsmu uzskaite: Identificējiet katru vietu, kur tiek izmantoti LLM: klientiem pieejamas funkcijas, iekšējie rīki un eksperimenti. Kartējiet, kādi dati kur nonāk, uz kāda tiesiskā pamata un kam ir piekļuve. Izmantojiet Zenith Blueprint pamata posmu, lai nodrošinātu, ka jūsu juridiskais reģistrs aptver visas ar AI saistītās GDPR, NIS2 un DORA prasības.

- Vispirms izveidojiet pārvaldību: Pirms izstrādes veiciet novērtējumu par ietekmi uz datu aizsardzību (DPIA) katrai AI funkcijai. Dokumentējiet tās nolūku, tiesisko pamatu un riskus. Ieviesiet pamata politikas, piemēram, Datu aizsardzības un privātuma politiku MVU un Informācijas drošības politiku MVU.

- Nostipriniet datus un piekļuvi: Ieviesiet spēcīgus tehniskos kontroles pasākumus. Pieņemiet Datu maskēšanas un pseidonimizācijas politiku un Testa datu un testa vides politiku MVU. Izmantojiet Zenith Controls, lai ieviestu un dokumentētu ISO 27001:2022 kontroles pasākumus 8.2 un 8.3 visām AI datu krātuvēm un cauruļvadiem.

- Iestrādājiet datu subjektu tiesības AI darbplūsmās: Atjauniniet DSAR un dzēšanas procedūras, iekļaujot ar AI saistītos datus. Dokumentējiet stratēģiju dzēšanas pieprasījumu apstrādei apmācītu modeļu kontekstā, koncentrējoties uz pseidonimizāciju un modeļa atkārtotas apmācības grafikiem.

- Pārņemiet kontroli pār AI piegādes ķēdi: Atjauniniet DPA ar trešo pušu LLM pakalpojumu sniedzējiem un ārpakalpojuma izstrādātājiem. Nodrošiniet, ka līgumi skaidri aizliedz neatļautu datu izmantošanu un pieprasa spēcīgus drošības pasākumus. Pārbaudiet, ka ārējās komandas ir apmācītas par jūsu datu apstrādes politikām.

Inovāciju ieviešana ar pārliecību

AI un GDPR krustpunkts ir jaunā atbilstības robeža. Pieņemot strukturētu, uz risku balstītu pieeju, varat izmantot mākslīgā intelekta pārveidojošo potenciālu, neapdraudot savu apņemšanos nodrošināt datu aizsardzību un privātumu.

Clarysec sniedz karti, rīkus un zināšanas, lai jūs vadītu šajā ceļā. Izmantojot:

- Zenith Blueprint: auditora 30 soļu ceļkarte — pakāpeniskai, ar GDPR saskaņotu AI kontroles pasākumu ieviešanai.

- Zenith Controls: savstarpējās atbilstības ceļvedis — lai apvienotu ISO 27001:2022 kontroles pasākumus ar GDPR, NIS2, DORA un NIST prasībām.

- Ražošanai gatavas politikas, piemēram, Datu aizsardzības un privātuma politika MVU, Datu maskēšanas un pseidonimizācijas politika un Testa datu un testa vides politika MVU, lai kodificētu jūsu noteikumus un apmierinātu auditoru prasības.

Jūs varat pāriet no ad hoc AI eksperimentiem uz auditgatavu AI spēju, kas rada uzticību regulatoriem, auditoriem un prasīgiem uzņēmumu klientiem. Jūs varat turpināt inovēt ar LLM un joprojām gulēt mierīgi.

Ja plānojat vai jau izmantojat AI funkcijas savā SaaS produktā, nākamais solis ir vienkāršs. Lejupielādējiet mūsu rīkkopu paraugus vai rezervējiet demonstrāciju, lai redzētu, kā Clarysec var palīdzēt izveidot AI programmu, kas ir ne tikai jaudīga, bet arī pierādāmi privāta un droša pēc projektēšanas.

Frequently Asked Questions

About the Author

Igor Petreski

Compliance Systems Architect, Clarysec LLC

Igor Petreski is a cybersecurity leader with over 30 years of experience in information technology and a dedicated decade specializing in global Governance, Risk, and Compliance (GRC).Core Credentials & Qualifications:• MSc in Cyber Security from Royal Holloway, University of London• PECB-Certified ISO/IEC 27001 Lead Auditor & Trainer• Certified Information Systems Auditor (CISA) from ISACA• Certified Information Security Manager (CISM) from ISACA • Certified Ethical Hacker from EC-Council