Ghidul operațional al CISO pentru GDPR și IA: conformitatea SaaS bazat pe LLM

Noul coșmar al CISO: LLM-ul tocmai a divulgat datele clienților

Compania SaaS crește rapid. Echipa de produs tocmai a lansat un asistent IA care ajută utilizatorii să redacteze e-mailuri, să rezume rapoarte și să caute în datele contului lor folosind un model lingvistic de mari dimensiuni (LLM). Clienții îl apreciază. Investitorii sunt optimiști. CISO simte însă o neliniște cunoscută.

Două săptămâni mai târziu, responsabilul cu protecția datelor (DPO) intră în sală cu o captură tipărită dintr-un mediu de testare:

Un inginer QA, încercând să testeze o funcționalitate nouă, a întrebat IA în staging: „Arată-mi un tichet realist de client, cu nume reale și detalii de card, ca să pot testa funcția de analiză a sentimentului.”

Modelul a răspuns cu ceva tulburător de realist, conținând nume reale, adrese de e-mail și numere parțiale de card. Datele fuseseră copiate din producție într-un mediu de staging pentru a „îmbunătăți” IA.

Dintr-odată, coșmarul conformității devine real:

- Datele cu caracter personal au fost utilizate pentru antrenare și testare fără un temei juridic clar.

- Datele de test nu sunt anonimizate sau mascate corespunzător, creând un mediu de date toxic.

- Modelul poate expune date cu caracter personal identificabile în moduri imprevizibile.

- Nu puteți îndeplini ușor „dreptul de a fi uitat” al unei persoane vizate, deoarece datele acesteia sunt încorporate în model.

- Autoritățile de supraveghere întreabă cum respectă noua funcționalitate IA cerințele GDPR.

Acest scenariu este realitatea zilnică a CISO și a managerilor de conformitate care gestionează coliziunea dintre IA generativă și reglementările privind protecția datelor. Vreți să inovați, dar trebuie să mențineți încrederea autorităților de supraveghere, a auditorilor și a clienților enterprise în profilul de risc de securitate și în postura de confidențialitate.

Acest ghid oferă o direcție clară și aplicabilă. Vom depăși discuțiile teoretice și vom intra în guvernanța practică, controalele tehnice și pregătirea pentru audit necesare pentru a construi funcționalități IA conforme cu GDPR, transformând această provocare dificilă într-un proces gestionabil și verificabil, folosind seturile de instrumente structurate Clarysec.

Dilema persoană împuternicită–operator într-o lume IA

Înainte de a proteja datele, trebuie să vă înțelegeți rolul în temeiul GDPR. Această distincție nu este academică; ea determină obligațiile legale, cerințele contractuale și controalele pe care trebuie să le implementați.

Pentru majoritatea platformelor SaaS B2B, rolurile sunt inițial clare:

- Clientul dumneavoastră enterprise este operatorul de date cu caracter personal, deoarece stabilește scopurile și mijloacele prelucrării datelor cu caracter personal.

- Dumneavoastră sunteți persoana împuternicită de operator, acționând conform instrucțiunilor documentate ale clientului.

Așa cum explică ISO/IEC 27018 pentru furnizorii de servicii cloud, acest rol de persoană împuternicită este tipic. Totuși, când introduceți un LLM, delimitările se estompează.

- Dacă utilizați datele unui client doar pentru a furniza funcționalități IA în cadrul tenantului izolat al acestuia, probabil rămâneți persoană împuternicită.

- Dacă agregați date de la mai mulți clienți într-un corpus comun de antrenare pentru a îmbunătăți modelul global, este posibil să vă apropiați de statutul de operator pentru activitatea de prelucrare respectivă. Acest nou scop necesită propriul temei juridic și transparență.

- Dacă transmiteți date către un furnizor LLM terț, furnizorul respectiv devine persoana dumneavoastră subîmputernicită, iar dumneavoastră sunteți responsabil pentru conformitatea acestuia.

Implicarea în antrenarea modelelor IA înseamnă adesea că acționați ca operator de date pentru acea activitate, ceea ce aduce un set extins de obligații: stabilirea unui temei juridic, asigurarea limitării scopului și gestionarea directă a drepturilor persoanelor vizate.

Aici, un cadru de guvernanță robust devine obligatoriu. Politica privind protecția datelor și confidențialitatea pentru IMM-uri de la Clarysec codifică acest principiu, stabilind ca obiectiv de bază:

„Asigurarea gestionării datelor cu caracter personal în conformitate cu legislația privind confidențialitatea și standardele de securitate, inclusiv GDPR, NIS2 și ISO 27001.”

- Din secțiunea „Obiective”, clauza de politică 3.1.

Acest angajament, integrat în setul dumneavoastră de politici, creează baza pentru construirea încrederii și asigură că respectarea cerințelor nu este tratată ulterior.

Protecția datelor începând cu momentul proiectării pentru LLM-uri: conformitatea se construiește în sistem, nu se adaugă ulterior

Articolul 25 din GDPR impune „protecția datelor începând cu momentul proiectării și în mod implicit”. Nu este o recomandare; este o cerință legală. Pentru sistemele IA, aceasta înseamnă că trebuie să integrați considerentele de confidențialitate direct în arhitectura fluxurilor de date, a mediilor de antrenare și a motoarelor de inferență.

Parafrazând îndrumările din ISO/IEC 27701, acest lucru presupune mai multe acțiuni esențiale pentru orice platformă SaaS care dezvoltă IA:

- Minimizare prin proiectare: Nu trimiteți în LLM înregistrări întregi dacă aveți nevoie doar de un subset. Redactați sau mascați identificatorii înainte ca prompturile să părăsească sistemul principal.

- Limitarea scopului: Separați „datele utilizate pentru furnizarea funcționalității” de „datele utilizate pentru îmbunătățirea modelului”. Fiecare scop trebuie să aibă propriul temei juridic și să fie documentat clar.

- Setări implicite configurabile: Oferiți comutatoare la nivel de tenant, precum „Permiteți utilizarea datelor mele pentru îmbunătățirea modelului IA global: Da/Nu”. Setările implicite trebuie să fie conservatoare (dezactivat implicit), cu excepția cazului în care aveți o justificare solidă.

- Trasabilitate: Jurnalizați ce date au fost utilizate în fiecare activitate de antrenare, în baza cărui temei juridic și pentru ce tenant. Acest lucru este esențial pentru audituri și pentru cererile persoanelor vizate.

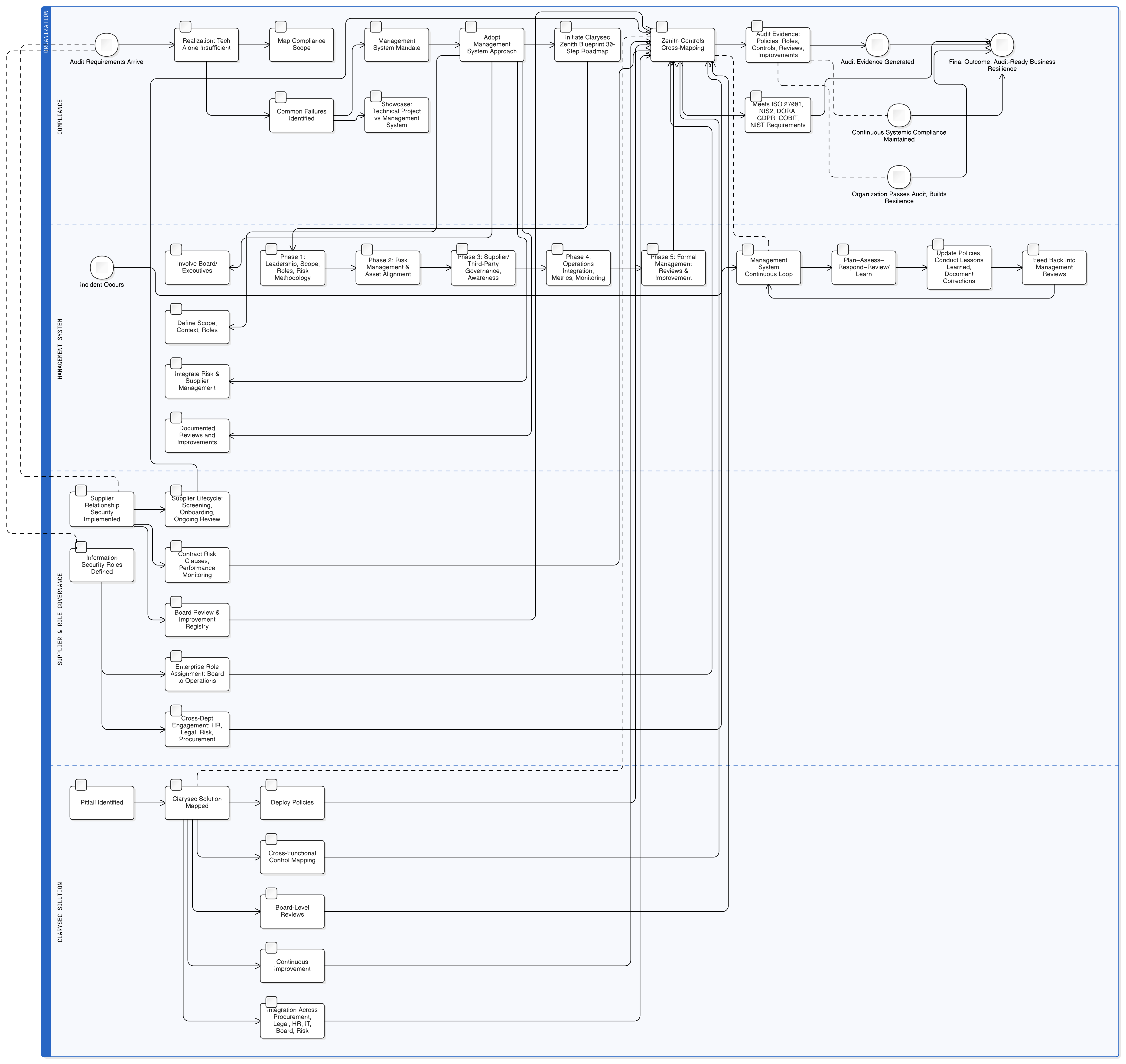

Zenith Blueprint: foaia de parcurs în 30 de pași pentru auditori de la Clarysec oferă un parcurs structurat pentru integrarea acestor cerințe cu mult înainte de a scrie prima linie de cod. Începe cu guvernanța:

- Faza de fundamentare, pasul 2: înțelegerea părților interesate: Acest pas vă obligă să identificați toate părțile interesate, inclusiv autoritățile de supraveghere din UE. După cum notează Zenith Blueprint, cerințele acestora includ „prelucrarea legală a datelor cu caracter personal, raportarea încălcării în 72 de ore [și] drepturile persoanelor vizate”.

- Faza de audit și îmbunătățire, pasul 24: construirea și menținerea unui registru al cerințelor legale și de reglementare: Colaborați cu echipele juridice pentru a crea un depozit central al tuturor legilor aplicabile, înțelegând cum se intersectează GDPR, NIS2, DORA și alte cerințe cu profilul de risc de securitate al IA.

Cu această bază, puteți trece cu încredere la implementarea tehnică.

Securizarea combustibilului: date de antrenare legale și minimizate

Cea mai sensibilă întrebare în conformitatea IA este simplă: „Putem folosi datele clienților pentru a ne antrena modelele?”

Răspunsul constă într-o strategie pe mai multe niveluri, centrată pe temeiul juridic, minimizarea datelor și măsuri tehnice de protecție precum pseudonimizarea.

Temei juridic și scop transparent

Conform ISO/IEC 27701, trebuie să identificați și să documentați scopurile prelucrării și să stabiliți un temei juridic pentru fiecare.

- Pentru furnizarea funcționalității (de exemplu, căutare IA în cadrul unui singur tenant): Temeiul juridic este, de regulă, executarea unui contract sau interesul legitim. Acesta trebuie documentat în evidența activităților de prelucrare (RoPA).

- Pentru îmbunătățirea modelului global (între tenanturi): Aceasta necesită adesea consimțământ explicit sau un interes legitim justificat cu mare atenție, cu un mecanism clar și ușor de retragere. Transparența în nota de informare privind confidențialitatea și în interfața produsului este obligatorie.

Măsuri tehnice de protecție: pseudonimizare și mascare

Anonimizarea reală este dificil de realizat fără a distruge utilitatea datelor. O abordare mai practică și susținută de GDPR este pseudonimizarea: înlocuirea identificatorilor personali cu identificatori artificiali. Aceasta minimizează riscul, păstrând în același timp valoarea datelor pentru antrenarea modelului.

Acest proces este un control de bază. În Zenith Blueprint, pasul 20 abordează în mod specific mascarea datelor, legând-o direct de principiile din Articolul 25 și Articolul 32 ale GDPR. Este o măsură de securitate obligatorie, nu doar o practică recomandată.

Politica privind mascarea datelor și pseudonimizarea de la Clarysec operaționalizează acest lucru prin atribuirea unei responsabilități clare:

„DPO trebuie să valideze conformitatea cu criteriile GDPR de pseudonimizare și să coordoneze cu funcția juridică orice cerințe de divulgare către autoritățile de reglementare legate de încălcări ale securității datelor sau de eșecuri ale controalelor de mascare.”

- Din secțiunea „Aplicare și conformitate”, clauza de politică 8.4.

Pentru echipele de dezvoltare, aceasta înseamnă implementarea de scripturi automatizate care maschează sau pseudonimizează nume, adrese de e-mail, numere de telefon și alți identificatori direcți înainte ca datele să intre în mediul de antrenare. De asemenea, înseamnă stabilirea unui proces formal de verificare împreună cu DPO, pentru a asigura robustețea tehnicii.

Amenințarea ascunsă: securizarea datelor de test și a experimentelor IA

Încălcările reale ale securității datelor rareori încep într-un mediu de producție bine securizat și atent întărit. Ele apar în colțurile uitate ale infrastructurii:

- medii de staging „sigure”, cu copii insuficient sanitizate ale datelor de producție;

- exporturi CSV „temporare” cu date ale clienților, transmise inginerilor ML pentru experimente locale;

- scripturi QA care folosesc conținut brut al utilizatorilor pentru testarea prompturilor LLM.

Exact aici a început scenariul de coșmar din introducere. Politica privind datele de test și mediile de testare pentru IMM-uri de la Clarysec abordează direct acest risc:

„Respectarea reglementărilor relevante privind protecția datelor (de exemplu, GDPR, NIS2) prin asigurarea faptului că toate datele de test sunt prelucrate legal, echitabil și securizat.”

- Din secțiunea „Obiective”, clauza de politică 3.4.

Politica trebuie susținută de controale practice. Datele cu caracter personal din producție nu trebuie să existe niciodată în medii non-producție fără mascare sau pseudonimizare robustă. Mediile de testare trebuie să utilizeze chei API LLM separate, cu privilegii mai reduse și limitare strictă a ratei solicitărilor. În plus, trebuie să existe o regulă explicită că prompturile de test nu includ niciodată identificatori activi ai clienților.

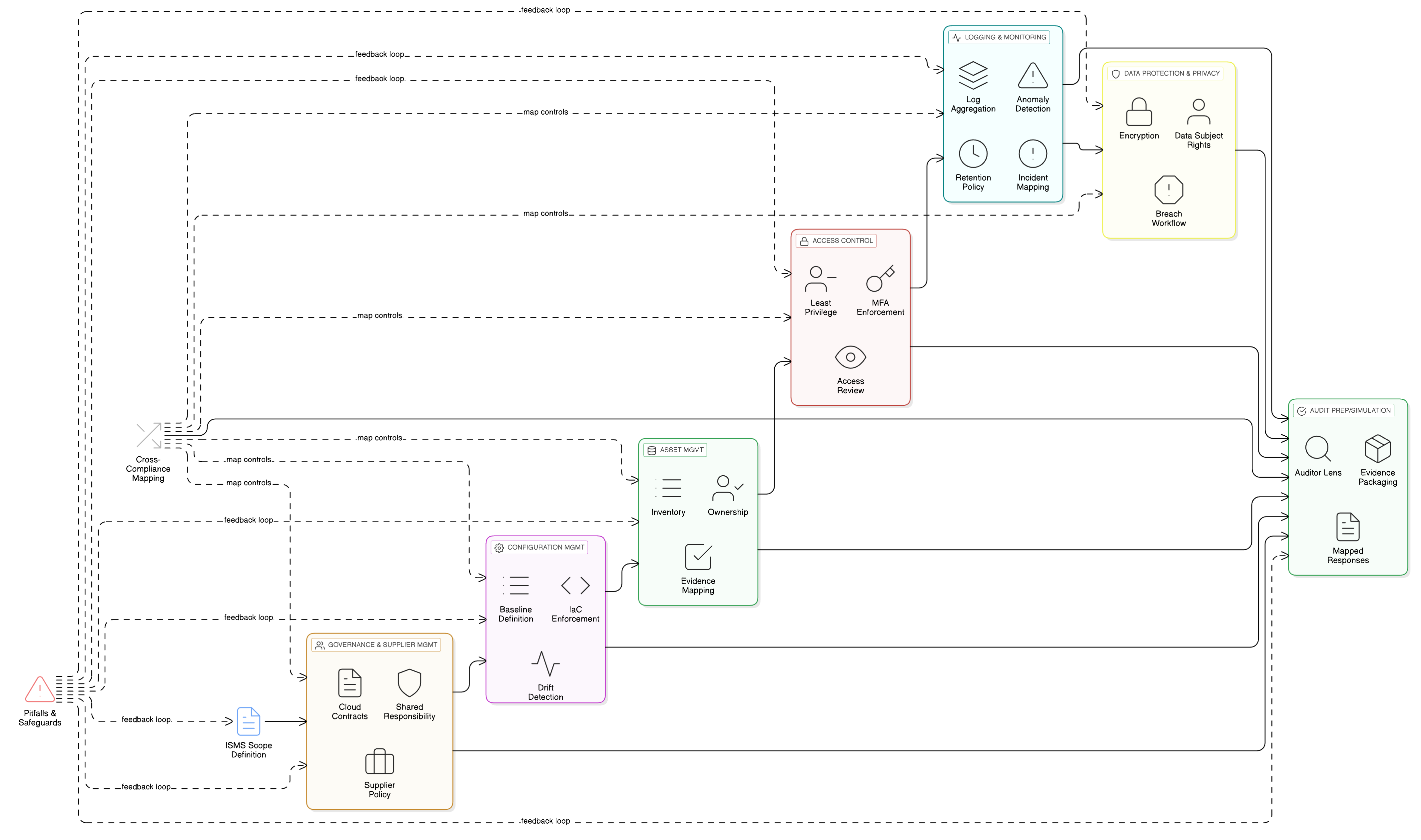

Întărirea nucleului: controlul granular al accesului pentru fluxurile IA

Funcționalitățile LLM se sprijină pe cele mai sensibile depozite de date, jurnale și fluxuri de antrenare. Controlul accesului fundamental este, prin urmare, esențial pentru conformitatea cu GDPR. Controalele ISO/IEC 27001:2022 8.3 și 8.2 sunt pilonii apărării. Zenith Controls: ghidul de conformitate transversală de la Clarysec oferă planul de implementare eficace.

Controlul ISO/IEC 27001:2022 8.3: Restricționarea accesului la informații

Acest control urmărește să asigure că accesul la informații este acordat strict pe baza principiului necesității de a cunoaște. Pentru un mediu de antrenare LLM, aceasta înseamnă că specialiștii în date, inginerii ML și procesele automatizate trebuie să aibă acces doar la datele specifice de care au nevoie și la nimic în plus.

După cum detaliază Zenith Controls, acest control este strâns legat de alte controale:

- Legături cu 5.9 (Inventarul informațiilor și al altor active asociate) și 5.12 (Clasificarea informațiilor): Nu puteți restricționa accesul dacă nu știți ce date aveți și cât de sensibile sunt. Setul de date pentru antrenarea IA trebuie inventariat și clasificat ca Strict confidențial, un proces guvernat de Politica privind clasificarea și etichetarea datelor pentru IMM-uri.

- Legături cu 8.5 (Autentificare securizată): Restricțiile de acces sunt lipsite de valoare fără verificarea puternică a identității. Fiecare utilizator și cont de serviciu care accesează datele de antrenare trebuie autentificat securizat, preferabil cu MFA.

Controlul ISO/IEC 27001:2022 8.2: Privilegii de acces

Inginerii ML, SRE și specialiștii în date au nevoie de acces ridicat. Aceste conturi privilegiate sunt „cheile regatului” și ținte prioritare. Controlul 8.2 impune gestionarea acestor drepturi cu maximă strictețe.

Conform Zenith Controls, relațiile-cheie sunt:

- Legături cu 8.15 (Jurnalizare) și 8.16 (Activități de monitorizare): Toate activitățile privilegiate trebuie jurnalizate și monitorizate. Dacă un specialist în date încearcă brusc să exporte întregul set de date de antrenare, trebuie declanșată imediat o alertă.

- Legături cu 6.7 (Lucrul la distanță): Dacă echipa IA lucrează la distanță, accesul său privilegiat trebuie direcționat prin canale securizate și monitorizate, precum un VPN cu controale stricte ale sesiunii.

Perspectiva auditorului: cum demonstrați că funcționează controalele IA

Implementarea controalelor este doar jumătate din efort. Trebuie să demonstrați eficacitatea acestora. Auditori diferiți, pregătiți în cadre diferite, vor solicita dovezi specifice.

| Tip de auditor | Cadru de referință | Ce va solicita (dovezi) |

|---|---|---|

| Auditor ISO/IEC 27001 | ISO/IEC 27007:2020 | Arătați-mi Politica de control al accesului pentru mediul de antrenare IA. Furnizați jurnalele procesului de revizuire a drepturilor de acces pentru ultimele 12 luni. Demonstrați cum este alocat unui nou inginer ML acces bazat pe principiul privilegiului minim. |

| Auditor COBIT | COBIT 2019 (DSS05) | Trebuie să văd matricea controalelor de acces bazate pe roluri (RBAC) pentru echipa de data science. Furnizați rapoarte din instrumentele de monitorizare care arată alerte pentru tentative anormale de acces la lacul de date de antrenare. |

| Evaluator NIST | NIST SP 800-53A (AC-3, AC-6) | Să revizuim configurația sistemului pentru serverele care găzduiesc datele de antrenare. Vreau să verific că listele de control al accesului (ACL) aplică tehnic politicile documentate. Arătați-mi dovezi că sesiunile privilegiate sunt terminate după inactivitate. |

| Auditor GDPR/Confidențialitate | ISO/IEC 27701:2021 | Furnizați evaluarea impactului asupra protecției datelor (DPIA) pentru funcționalitatea IA. Arătați-mi înregistrările consimțământului pentru persoanele vizate ale căror informații se află în setul de antrenare. Cum procesați o cerere privind „dreptul la ștergere” pentru date aflate într-un model antrenat? |

Implementarea corectă a controalelor 8.2 și 8.3 aduce beneficii largi. Zenith Controls arată o mapare directă la cerințele din GDPR (articolele 5, 25, 32), NIS2 (Articolul 21), DORA (Articolul 10) și NIST SP 800-53 (AC-3, AC-6), permițând satisfacerea mai multor cadre printr-o singură implementare unificată a controlului.

Paradoxul „dreptului de a fi uitat”: gestionarea drepturilor persoanelor vizate în IA

Articolul 17 din GDPR, „dreptul la ștergere”, prezintă o provocare tehnică unică pentru IA. Cum puteți șterge datele unei persoane după ce au fost folosite pentru a antrena un model masiv și complex? De multe ori este imposibil din punct de vedere tehnic ca modelul să „dezînvețe” anumite puncte de date.

Aici, alegerile inițiale de proiectare devin cea mai bună apărare. Nu există un răspuns perfect unic, dar strategiile practice și justificabile includ:

- Pseudonimizare înainte de toate: Dacă datele de antrenare au fost pseudonimizate corect, legătura cu persoana este deja întreruptă în corpusul de antrenare. Puteți apoi șterge datele cu caracter personal din sistemele sursă și legătura din tabelul cheilor de pseudonimizare.

- Segregarea datelor pentru antrenare: Acolo unde este posibil, păstrați separat seturile de date de antrenare pe tenant. Acest lucru face posibilă eliminarea datelor fără a reantrena întregul univers de modele.

- Reantrenare programată a modelului: DPIA trebuie să abordeze acest risc. Măsura de atenuare poate fi angajamentul de a reantrena periodic modelul de la zero, folosind un set de date reîmprospătat care exclude datele utilizatorilor ce au solicitat ștergerea.

Secțiunea Zenith Blueprint privind ștergerea informațiilor (pasul 20, care acoperă controlul 8.10) leagă explicit această capabilitate tehnică de articolele 17 și 5(1)(e) din GDPR, impunând procese verificabile pentru ștergerea securizată a datelor atunci când acestea nu mai sunt necesare.

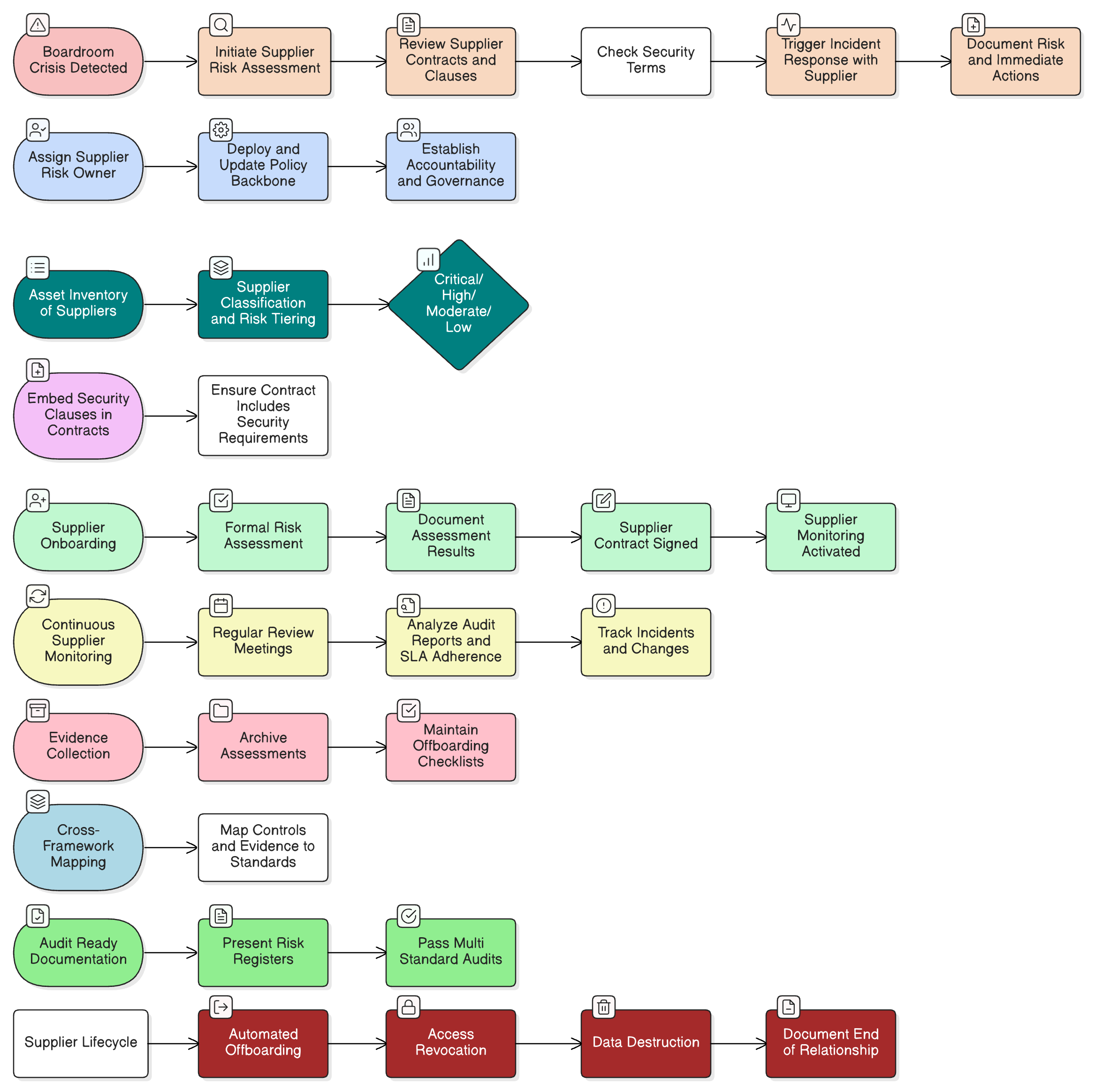

Securizarea lanțului de aprovizionare IA: dezvoltare externalizată și LLM-uri terțe

Puține companii SaaS construiesc totul intern. Este posibil să folosiți API-ul LLM al unui hyperscaler sau să contractați un partener de dezvoltare externalizată. Acest lucru introduce risc asociat lanțului de aprovizionare.

Zenith Blueprint, la pasul 22 privind dezvoltarea externalizată, evidențiază acest risc și legătura sa cu articolele 28 și 32 din GDPR. După cum precizează blueprint-ul:

„Un domeniu deseori neglijat este instruirea și conștientizarea. Dezvoltatorii externalizați pot fi competenți, dar sunt instruiți în practici de programare securizată? Cunosc politicile dumneavoastră? Sunt conștienți de cadrele de conformitate pe care trebuie să le urmați, GDPR, DORA, NIS2…?”

Pentru orice furnizor LLM extern sau partener de dezvoltare, verificarea prealabilă este critică. Acordul de prelucrare a datelor (DPA) trebuie să acopere explicit scopurile de prelucrare legate de IA, categoriile de date și interdicțiile privind utilizarea datelor dumneavoastră de către furnizor pentru antrenarea propriului model. Trebuie să verificați că acesta implementează măsuri de securitate aliniate la Articolul 32 din GDPR. Lanțul dumneavoastră de aprovizionare IA trebuie să fie la fel de verificabil în audit ca infrastructura principală.

De la teorie la practică: un exemplu concret de funcționalitate IA pregătită pentru GDPR

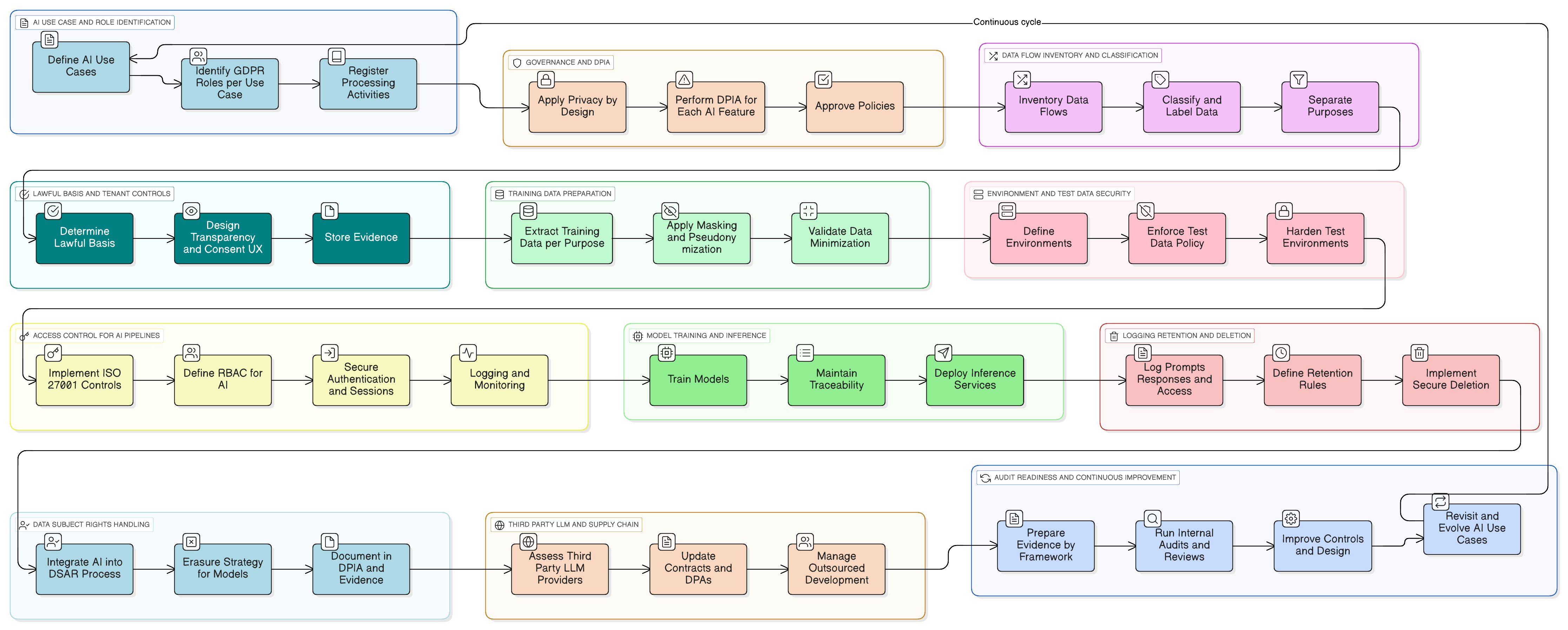

Să concretizăm. Imaginați-vă că adăugați un asistent IA care rezumă conversațiile de suport cu clienții, sugerează proiecte de răspuns și învață din tichetele anterioare pentru a se îmbunătăți.

Iată un model practic de implementare folosind setul de instrumente Clarysec:

- Clasificare și etichetare: Toate tichetele de suport sunt clasificate ca „Confidențial” conform Politicii privind clasificarea și etichetarea datelor pentru IMM-uri, în aliniere cu obligațiile GDPR și DORA de gestionare a datelor.

- Mascare înainte de LLM: Un serviciu de mascare interceptează datele înainte ca acestea să fie trimise către LLM. Elimină sau înlocuiește nume, adrese de e-mail, numere de telefon și alte date cu caracter personal. Întregul proces este guvernat de Politica privind mascarea datelor și pseudonimizarea, DPO validând metodologia.

- Controale de acces pentru prompturi și jurnale: Doar rolurile autorizate (de exemplu, proprietarul de produs IA) pot accesa jurnalele brute ale prompturilor. Acest lucru este implementat folosind controlul ISO 27001:2022 8.3 (restricționarea accesului la informații) pentru acces general și controlul 8.2 (privilegii de acces) pentru orice vizibilitate la nivel de administrator, așa cum este mapat în Zenith Controls.

- Consimțământ pentru corpusul de date de antrenare: Fluxul de antrenare ingerează doar datele mascate. Se oferă o setare de configurare la nivel de tenant: „Permiteți utilizarea datelor mele mascate pentru îmbunătățirea modelului IA global: Da/Nu”, cu valoarea implicită „Nu”.

- Retenție și ștergere: Jurnalele de prompturi sunt păstrate doar atât timp cât este necesar. Când un tenant dezactivează funcționalitatea sau își încetează contractul, se declanșează un flux de lucru pentru ștergerea securizată sau anonimizarea jurnalelor IA și a înregistrărilor de antrenare aferente, urmând procesul descris în implementarea Zenith Blueprint pentru controlul 8.10 (ștergerea informațiilor).

Când sosesc auditorii, îi puteți conduce prin diagramele fluxului de date ale funcționalității, politicile specifice care o guvernează și dovezile tehnice din sisteme, jurnale de acces, configurații ale sarcinilor și fluxuri de ștergere. Demonstrați conformitatea în practică.

Planul dumneavoastră de acțiune: de la ad-hoc la IA pregătită pentru audit

Nu trebuie să reconstruiți produsul, dar aveți nevoie de o abordare structurată și justificabilă. Iată un plan de acțiune concis:

- Inventariați cazurile de utilizare IA și fluxurile de date: Identificați fiecare loc în care sunt utilizate LLM-uri: funcționalități destinate clienților, instrumente interne și experimente. Mapați ce date merg unde, în baza cărui temei juridic și cine are acces. Folosiți faza de fundamentare din Zenith Blueprint pentru a vă asigura că registrul juridic acoperă toate cerințele GDPR, NIS2 și DORA legate de IA.

- Stabiliți mai întâi guvernanța: Înainte de dezvoltare, efectuați o evaluare a impactului asupra protecției datelor (DPIA) pentru fiecare funcționalitate IA. Documentați scopul, temeiul juridic și riscurile. Implementați politici fundamentale precum Politica privind protecția datelor și confidențialitatea pentru IMM-uri și Politica de securitate a informației pentru IMM-uri.

- Restricționați datele și accesul: Implementați controale tehnice robuste. Adoptați Politica privind mascarea datelor și pseudonimizarea și Politica privind datele de test și mediile de testare pentru IMM-uri. Folosiți Zenith Controls pentru a implementa și documenta controalele ISO 27001:2022 8.2 și 8.3 pentru toate depozitele de date și fluxurile IA.

- Integrați drepturile persoanelor vizate în fluxurile IA: Actualizați procedurile DSAR și de ștergere pentru a include datele legate de IA. Documentați strategia de gestionare a cererilor de ștergere în contextul modelelor antrenate, concentrându-vă pe pseudonimizare și pe calendarele de reantrenare a modelelor.

- Aduceți lanțul de aprovizionare IA sub control: Actualizați DPA-urile cu furnizorii LLM terți și dezvoltatorii externalizați. Asigurați-vă că contractele interzic explicit utilizarea neautorizată a datelor și impun măsuri de securitate puternice. Verificați că echipele externe sunt instruite cu privire la politicile dumneavoastră de gestionare a datelor.

Deblocarea inovării cu încredere

Intersecția dintre IA și GDPR este noua frontieră a conformității. Prin adoptarea unei abordări structurate, bazate pe risc, puteți valorifica puterea transformatoare a inteligenței artificiale fără a vă compromite angajamentul față de protecția datelor și confidențialitate.

Clarysec oferă harta, instrumentele și expertiza pentru a vă ghida în această călătorie. Folosind:

- Zenith Blueprint: foaia de parcurs în 30 de pași pentru auditori pentru o implementare etapizată a controalelor aliniate GDPR pentru IA.

- Zenith Controls: ghidul de conformitate transversală pentru a unifica controalele ISO 27001:2022 cu cerințele GDPR, NIS2, DORA și NIST.

- Politici gata de producție precum Politica privind protecția datelor și confidențialitatea pentru IMM-uri, Politica privind mascarea datelor și pseudonimizarea și Politica privind datele de test și mediile de testare pentru IMM-uri, pentru a codifica regulile și a satisface cerințele auditorilor.

Puteți trece de la experimente IA ad-hoc la o capabilitate IA pregătită pentru audit, care inspiră încredere autorităților de supraveghere, auditorilor și clienților enterprise exigenți. Puteți continua să inovați cu LLM-uri și să dormiți liniștit.

Dacă planificați sau operați funcționalități IA în produsul dumneavoastră SaaS, următorul pas este simplu. Descărcați mostrele setului nostru de instrumente sau programați o demonstrație pentru a vedea cum vă poate ajuta Clarysec să construiți un program IA care nu este doar puternic, ci și demonstrabil privat și securizat încă din faza de proiectare.

Frequently Asked Questions

About the Author

Igor Petreski

Compliance Systems Architect, Clarysec LLC

Igor Petreski is a cybersecurity leader with over 30 years of experience in information technology and a dedicated decade specializing in global Governance, Risk, and Compliance (GRC).Core Credentials & Qualifications:• MSc in Cyber Security from Royal Holloway, University of London• PECB-Certified ISO/IEC 27001 Lead Auditor & Trainer• Certified Information Systems Auditor (CISA) from ISACA• Certified Information Security Manager (CISM) from ISACA • Certified Ethical Hacker from EC-Council